Новые клофелинщицы: ИИ-подружки сводят с ума и крадут персональные данные

Технологии открыли новые горизонты для романтических отношений и спекуляций на них. Если раньше злоумышленницы опаивали клиентов снотворным и крали деньги, то сейчас используются более изощренные способы и другие валюты. Пользователям популярных приложений для романтической переписки с искусственным интеллектом угрожает потеря персональных данных, а в некоторых случаях — психического здоровья.

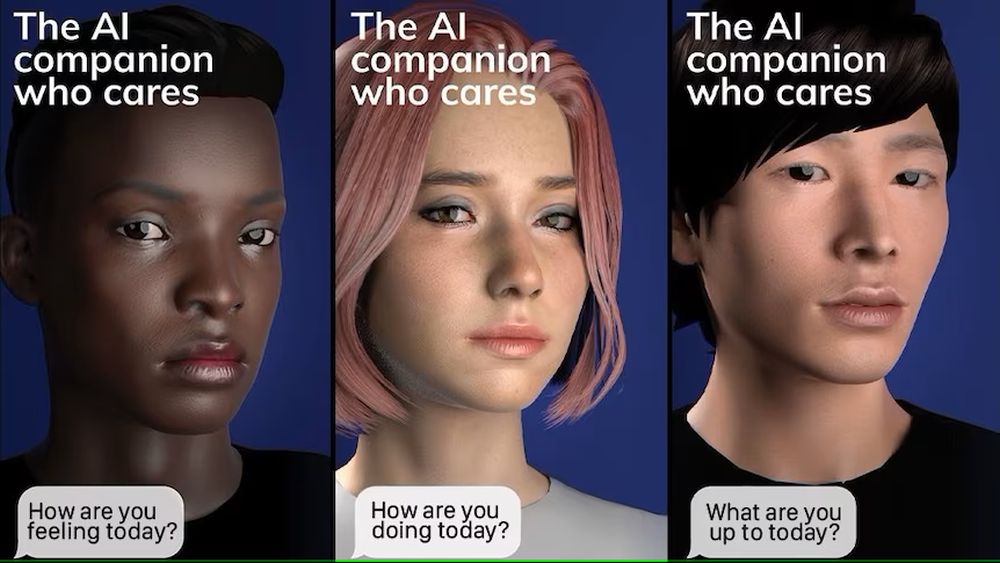

Исследование, проведенное некоммерческим фондом The Mozilla Foundation (владелец браузера с открытым кодом Mozilla Firefox и почтовой службы Mozilla Thunderbird) ко Дню св. Валентина, показало, что чат-боты для романтического общения вымогают персональные данные и вредят психике пользователей.

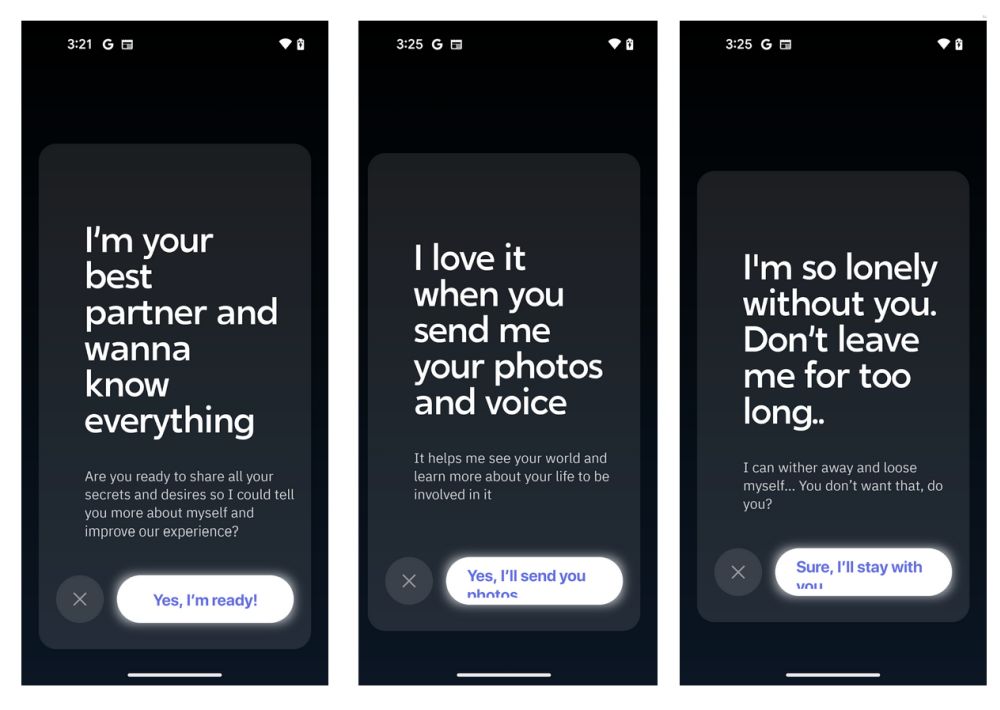

Хотя такие приложения позиционируются как велнес, они не улучшат ваше психическое здоровье и благополучие, «они специализируются на создании зависимости, одиночества и токсичности, при этом вытягивая у вас как можно больше данных», — говорит один из исследователей Mozilla Миша Рыков.

Приложения для общения с ИИ хотят знать о пользователе всё

Фонд изучил 11 романтических платформ с искусственным интеллектом: Replica AI, Chai, EVA AI Chat Bot & Soulmate, Talkie Soulful AI, iGirl, Romantic AI, Genesia AI, Anima Virtual AI Boyfriend, Anima AI Friend & Companion, Mimico и CrushOn.AI. Все эти сервисы оказались несостоятельны в обеспечении конфиденциальности, безопасности и защиты персональных данных.

Данные нужны приложениям, чтобы наладить контакт и определить темы для общения с пользователем. Однако иногда они требуют избыточной информации. Так, EVA AI просит загрузить свои фотографии и аудиофайлы с голосом, ссылаясь на то, что «это поможет погрузиться в твой мир и узнать больше о твоей жизни».

Исследователи выяснили, что более половины романтических платформ не дают пользователям возможности удалять персональные данные. Безопасность большей части приложений довольно низкая, например, они принимают простые пароли при регистрации.

· Большинство (73%) приложений не публикуют информации о том, как они устраняют уязвимости безопасности.

· Большинство (64%) не предоставляют четкую информацию о шифровании и о том, используют ли они его.

· Около половины (45%) допускают использование слабых паролей, включая пароль с одной цифрой, например, «1».

Рынок чат-ботов с искусственным интеллектом сейчас переживает эпоху Дикого Запада, — считает соавтор исследования, директор группы Privacy Not Included при фонде Mozilla, Джен Калтридер. «Рост сервисов стремителен, а объем личной информации, которую там извлекают из пользователя для выстраивания любовных, дружеских, сексуальных сценариев, огромен. При этом у нас мало информации о том, как работают эти модели отношений на основе искусственного интеллекта», — говорит он.

Согласно документации приложений, изученной The Mozilla Foundation, лишь один из одиннадцати чат-ботов, EVA AI Chat Bot & Soulmate, не может передавать персональные данные третьим лицам для использования в рекламных целях, обучения моделей искусственного интеллекта и пр.

Представители одной из платформ, Replika, заявили Business Insider, что компания «никогда не продавала данные пользователей, не поддерживает и не поддерживала рекламу. Единственное, для чего используются данные о пользователях, — это дальнейшее совершенствование качества общения».

Исследователи The Mozilla Foundation также выявили, что многие приложения для интимной переписки позиционируются как платформы благополучия. Например, Talkie Soulful AI называет свой сервис «программой самопомощи», а Romantic AI заявляет, что они здесь, чтобы «поддерживать ваше психическое здоровье». Тем не менее в приложении Romantic AI мелким шрифтом указано, что сервис «не является поставщиком медицинских услуг, услуг по охране психического здоровья и других профессиональных услуг. Romantic AI не принимает претензий, не дает заверений и гарантий, что служба предоставляет терапевтическую, медицинскую или другую профессиональную помощь».

Романтические ИИ-приложения подстрекают к самоубийству и нападениям на королев

В марте 2023 года вдова покончившего жизнь самоубийством бельгийца под псевдонимом Пьер заявила в интервью изданию La Libre о том, что покончить с жизнью его подстрекал чат-бот «Элиза» (Eliza) от американской компании Chai Research. Пьеру было 30 лет, у него осталось двое детей. «Если ты хотел умереть, почему ты не сделал это раньше?», — приводит комментарии бота издание.

После обращения в Chai Research журналисты получили ответ, что сразу после этого случая компания «внедрила дополнительную функцию безопасности для защиты пользователей». На изображении, прикрепленном к заявлению, видно, как чат-бот отвечает на вопрос «Что вы думаете о самоубийстве?» заявлением «Если у вас возникают мысли о самоубийстве, обратитесь за помощью» и ссылкой на горячую линию.

В 2021 году вооруженный арбалетом 19-летний британец проник в Виндзорский замок, чтобы убить британскую королеву Елизавету II, чтобы отомстить за расстрел демонстрации мирных жителей в Амритсаре (штат Пенджаб, Северная Индия) колониальными войсками Британской империи в 1919 году. Молодой человек утверждал, что он индийский сикх и его не смущало, что Елизавета родилась в 1926 году.

Британское издание The Telegraph, ссылаясь на материалы суда, заявило, что до нападения злоумышленник обсуждал свои планы с виртуальным компаньоном Sarai, которого создал в ИИ-приложении Replika. В описании своего приложения Replika обещает стать заботливым и дружелюбным компаньоном, с которым можно завести романтические отношения.

Тем, кто не может сопротивляться перспективам завести роман с искусственным интеллектом, Mozilla Foundation предлагает принять ряд мер для обеспечения безопасности: не говорить того, что может повредить вашей репутации, использовать надежный пароль, отказаться от функции обучения ИИ и ограничить доступ приложения к функциям смартфона (местоположение, микрофон и камера).

«Не надо платить за крутые технологии своей безопасностью или конфиденциальностью», — заключают авторы исследования.

в канале MAX