Рынку военных ИИ-технологий предрекают четырехкратный рост

Революция войны

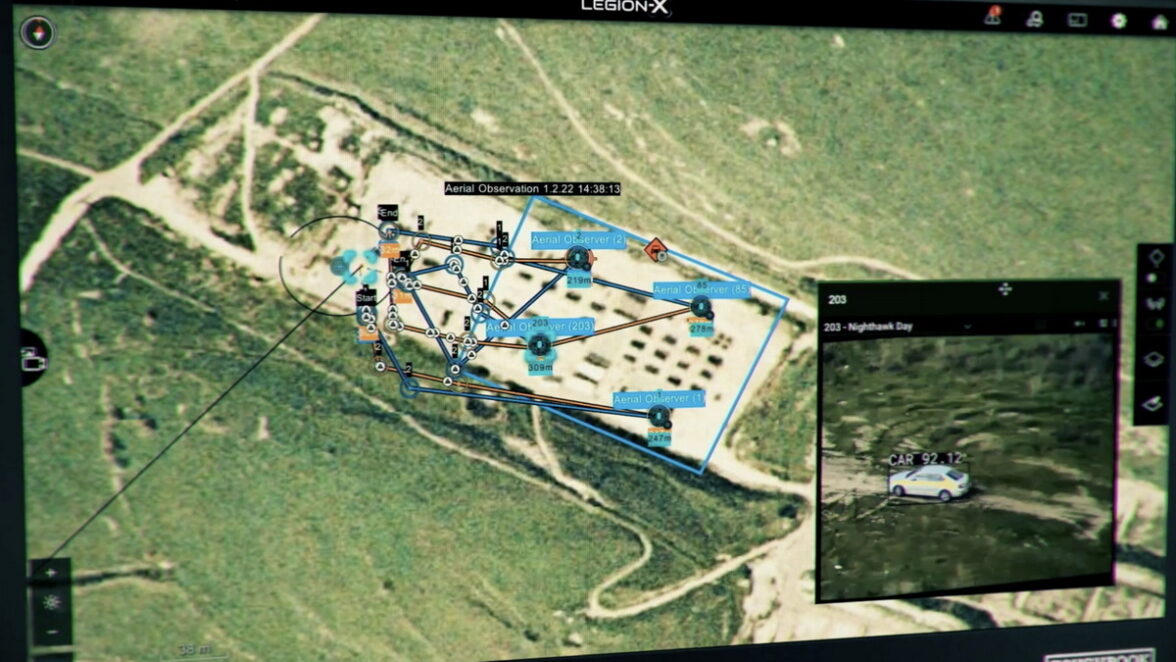

© Elbit Systems

Технологии ИИ позволяют создавать военные системы с невиданными ранее способностями самостоятельно принимать решения. Возникновение новых и обострение старых конфликтов рождает спрос на военное применение ИИ-технологий и предоставляет массу возможностей для их обкатки и совершенствования. Эксперты уверены, что революция в технологиях войны, сравнимая лишь с появлением ядерного оружия, уже началась.

В одних лишь США, как пишет Guardian, идет работа над более чем восемьюстами военными ИИ-проектами, а Пентагон только на 2024 год запросил из бюджета на эти цели $1,8 млрд — втрое больше, чем потратил с января по август 2023-го ($557 млн). Весь остальной госаппарат США потратил за тот же период на ИИ всего $118 млн. Как подсчитали в вашингтонском аналитическом центре Brookings Institution, если каждый из уже заключенных американскими военными контрактов с разработчиками ИИ будет реализован по максимуму, сумма затрат составит уже $4,3 млрд.

Только программа Replicator Initiative по разработке беспилотников, способных действовать сообща в виде роя и обнаруживать цели при помощи ИИ, обойдется американским налогоплательщикам к началу 2025 года в миллиард долларов. А ВВС США потратят за пять лет с 2023-го по 2028 год $6 млрд на создание 1000 автономных летательных аппаратов для оказания поддержки боевым самолетам. ИИ поможет им работать в связке с пилотируемыми самолетами следующего поколения и повысит выживаемость на поле боя.

Fury — беспилотник-«напарник» с ИИ компании Anduril. © Breaking Defense

Согласно отчету аналитической компании Spherical Insights, к 2032 году объем глобального рынка ИИ-технологий военного назначения, в 2022 году оценивавшийся в $8,4 млрд, вырастет до $33,8 млрд.

Новая атомная бомба

За эти растущие бюджеты по всему миру соревнуются десятки технологических и оборонных компаний, не испытывающие недостатка в инвесторах. Так, разрабатывающий автономные дроны-убийцы, беспилотные истребители и подводные аппараты стартап Anduril с инвестициями $2,3 млрд полтора года назад оценивался в $8,5 млрд, а сейчас собирается привлечь еще $1,5 млрд исходя из оценки всей компании $12,5 млрд. Основатель стартапа — 31-летний предприниматель и инженер Палмер Лаки, создавший, а в 2014 году продавший Марку Цукербергу за $2 млрд бизнес по производству шлемов виртуальной реальности Oculus. Именно Anduril, а не Boeing или Lockheed Martin достался $6-миллиардный контракт на создание автономных самолетов поддержки. В презентации для инвесторов компания заявляет, что ее миссия — «спасти западную цивилизацию».

Palantir, основанная бизнесменом Питером Тилем компания с рыночной капитализацией $60 млрд, работает сразу над несколькими оборонными контрактами, предполагающими применение ИИ: от проекта по разминированию на Украине до мобильного командного пункта TITAN, в котором алгоритмы искусственного интеллекта обобщают данные спутниковой разведки и других источников для выявления целей и постановки задач подразделениям. Как сообщало издание Defensescoop, в мае Palantir получил еще один контракт Пентагона на $480 миллионов, в рамках которого разработает масштабную систему определения целей для моментального нанесения ударов — MAVEN Smart System. Как минимум две ИИ-системы Palantir американские военные уже применяют на Ближнем Востоке. Гендиректор компании Алекс Карп часто упоминает руководителя американской программы по созданию атомной бомбы Роберта Оппенгеймера и считает, что для США выиграть гонку ИИ-вооружений с Китаем так же важно, как было важно создать первыми атомную бомбу.

Аналогичные процессы, пусть и в меньшем масштабе, идут и по эту сторону Атлантики. Германский стартап Helsing, разрабатывающий оборонное ПО (разумеется, с ИИ) в июле привлек полмиллиарда долларов инвестиций исходя из оценки $5,4 млрд. Израильская Elbit Systems в прошлом году поставила минобороны страны только умных боеприпасов на $760 млн, а выручка компании за 2023 год составила около $6 млрд. 85% дронов, поставляемых армии обороны Израиля, выпускаются Elbit. Компания выкладывает на YouTube вот такие зрелищные видеоролики, демонстрирующие возможности ее беспилотников-камикадзе с искусственным интеллектом:

OpenAI отказалась от пацифизма

Заработать на продаже ИИ-технологий военным стремятся и «мирные» лидеры IT-отрасли. Единственное, что их до какой-то степени ограничивает — возможные имиджевые потери и недовольство сотрудников. The Intercept писал в апреле со ссылкой на оказавшуюся в распоряжении издания презентацию, что Microsoft в прошлом году предлагала своим заказчикам в Пентагоне использовать в ПО для систем управления боевыми операциями разработку OpenAI — генератор картинок DALL-E.

Речь шла о том, чтобы создавать при помощи ИИ дополнительные визуальные материалы для тренировки этих систем. В Microsoft считают, что это позволило бы военному ИИ благодаря более точной оценке ситуации на поле боя эффективнее обнаруживать и уничтожать цели. В Microsoft признали, что предлагали DALL-E Пентагону, но утверждают, что пока идею не реализовывали.

Тем не менее, в январе 2024 года СМИ обратили внимание на изменение в официальной политике OpenAI, опубликованной на ее сайте. Оттуда исчезло положение о запрете на применение генеративного ИИ компании для «активности, имеющей высокий риск причинения физического вреда, включая разработку вооружений и военные действия». А вице-президент компании Анна Маканью заявила в интервью Bloomberg на Давосском форуме, что OpenAI начала сотрудничать с минобороны США — правда, не для создания оружия, а в разработке инструментов для защиты от хакеров. Эта работа в интересах нацбезопасности, по ее мнению, полностью соответствует декларируемой OpenAI цели «создания ИИ на благо всего человечества».

Google в 2019 году не стала продлевать контракт с Пентагоном на использование ее ИИ для анализа видео с камер боевых беспилотников после массовых протестов сотрудников, призвавших руководство вспомнить о ценностях компании. В итоге контракт достался Microsoft и Amazon, а в политику Google добавили запрет на использование ее ИИ-технологий для «проектов в области вооружений или слежки, нарушающих международные нормы». Но в компании подчеркнули, что продолжат участвовать в тендерах на оборонные контракты, если они не касаются создания оружия. Осенью прошлого года IT-гигант выиграл контракт израильского правительства стоимостью $1,2 млрд, по которому предоставляет различные облачные сервисы, в том числе для работы ИИ-системы сбора данных и слежки за палестинцами. В этот раз руководство Google не прогнулось и отреагировало на недовольство сотрудников жестко — всех участников акции протеста в офисе компании уволили.

При этом и Google, и Microsoft, а еще Amazon и Oracle получают деньги от Пентагона по $9-миллиардному контракту на предоставление облачных сервисов. А Microsoft в 2021 году выиграла контракт на поставку армии США шлемов дополненной реальности для солдат, по которому может за 10 лет заработать до $22 млрд.

Запретить роботов-убийц не получится

Исследователи и эксперты обращают внимание на риски, связанные с непрозрачностью военного применения ИИ-технологий. Профессор юриспруденции Университета Виргинии Эшли Дикс в интервью Guardian назвала эту ситуацию «двойным черным ящиком». Во-первых, сами проприетарные алгоритмы являются коммерческой тайной создавших их компаний. Во-вторых, военные не собираются делиться с общественностью какой-либо информацией о любых проблемах с их внедрением и применением. Например, израильские журналисты выяснили, что армия страны решила внедрить ИИ-систему, выявляющую цели для авиаударов, хотя знала, что она ошибается в 10% случаев — то есть в одном случае из десяти может привести к гибели мирного населения.

Правительства и производители боевых ИИ-систем настаивают, что никаких этических проблем с ИИ нет: они не собираются доверять роботам ключевое решение — стрелять или не стрелять по цели, его всегда будет принимать человек. Однако нельзя отрицать, что на это решение в значительной степени повлияют рекомендации ИИ. Так что ситуации, в которых из-за ошибки алгоритма погибнут невинные люди, будут случаться неизбежно.

Такие организации, как Международный комитет Красного Креста, выступают за то, чтобы на международном уровне ввести запрет на полностью автономные (то есть обнаруживающие цель и наносящие удар без вмешательства человека) ИИ-вооружения, либо хотя бы жестко ограничить ситуации, в которых разрешено их применение. Однако страны-разработчики боевых роботов от США и России до Китая и Индии отвергают любые ограничения в этой сфере.

в канале MAX