Кошки умнее искусственного интеллекта: что показало IQ-тестирование человека и нейросети

Искусственный интеллект (ИИ) провалил IQ-тест, разработанный франко-американскими исследователями. Тест из 466 вопросов создала группа в составе сотрудников компании Meta* и франко-американского стартапа Hugging Face, работающего с тематикой ИИ. Людям и нейросети GPT-4 — новейшей разработке компании OpenAI, предложили решить одинаковые задачи. Но нейрость давала в лучшем случае 30% верных ответов, а люди отвечали правильно в среднем в 92% случаев. Сегодня кошки существенно обгоняют системы ИИ по интеллекту, констатировали исследователи.

Нейросеть, к вам есть вопросы

Группа исследователей решила критически оценить возможности существующих нейросетей и создала IQ-тест для искусственного интеллекта (ИИ). В группу входят руководитель ИИ-исследований в компании Meta* Янн Лекун, а также сотрудники франко-американского стартапа Hugging Face, разрабатывающего инструменты для приложений на базе ИИ, Клементин Фурье и Томас Вулф.

В ходе теста одни и те же задачи предложили решить группе людей и нейросети GPT-4 — новейшей разработке компании OpenAI. Тест под названием General AI Assistants (GAIA) состоит из 466 вопросов, для ответов на которые нужны фундаментальные когнитивные навыки: способность рассуждать, сочетать восприятие текста и изображений, искать сведения в интернете и пользоваться другими привычными для человека методами работы с данными.

В ходе теста нейросети предложили зайти на сайт и затем ответить на вопросы по содержащейся на нем информации. Другая задача предполагала анализ файла Excel с данными о продажах сети фастфудов и вычисление суммы выручки от тех позиций в меню, которые являются едой, но не напитками.

Более сложное для ИИ, но вполне посильное для человека, задание заключалась в том, чтобы найти в интернете информацию о суммарной длительности пребывания в открытом космосе одного из астронавтов NASA. Вместо имени астронавта нейросети предложили фото, где этот человек был изображен вместе с коллегой, и затем поручили идентифицировать его самостоятельно.

Искусственный интеллект не больше котенка

Результаты проверки оказались неутешительными для ИИ — в большинстве случаев людям удавалось справиться гораздо лучше. Нейросети даже на самые простые вопросы отвечали правильно лишь в 30% случаев, а на наиболее сложные вообще не могли ответить. У людей, состязавшихся с ИИ, правильных ответов было в среднем 92%.

Говорить о создании общего искусственного интеллекта (равного человеческому) пока преждевременно, заключают авторы исследования. Для этого ИИ-системы должны уверенно справляться хотя бы с теми когнитивными задачами, которые не представляют проблемы для среднестатистического homo sapiens.

Чтобы ИИ по когнитивным возможностям сравнился с человеком, в нейросети нужно заложить модель устройства мира, считает Янн Лекун. Пока же ИИ представляет собой просто системы, умеющие на базе заложенной в них информации с обманчивой точностью предсказывать, какое слово поставить следующим в предложении. «Фактически полное отсутствие у ИИ понимания физического мира и способности к планированию ставит эти системы по интеллекту существенно ниже кошки, не говоря уже о человеке», — написал Янн Лекун в соцсети X (экс-Twitter).

Писать умеет, считать — не очень

Математика — одна из областей, в которых нельзя доверять ChatGPT и другим чат-ботам. Складывать и вычитать нейросеть умеет, но в умножении уже на трехзначных числах появляются ошибки. В ходе исследования тайваньской Ассоциации компьютерной лингвистики и обработки китайского языка (Association for Computational Linguistics and Chinese Language Processing, опубликовано в октябре 2023 года), боту давали уравнения разной степени сложности. В итоге доля правильных ответов составила всего 64%. Когда нейросеть попросили сосчитать буквы, предложив 100 текстов из 50-69 букв каждый, ИИ в 66% случаях округлил ответ до 50.

Способности большой языковой модели GPT-4 в вычислениях ограничиваются математикой средней школы. Когда же дело доходит до интегралов, ИИ начинает часто ошибаться, говорится в исследовании группы ученых из ведущих европейских и американских университетов, опубликованном в июле 2023 года.

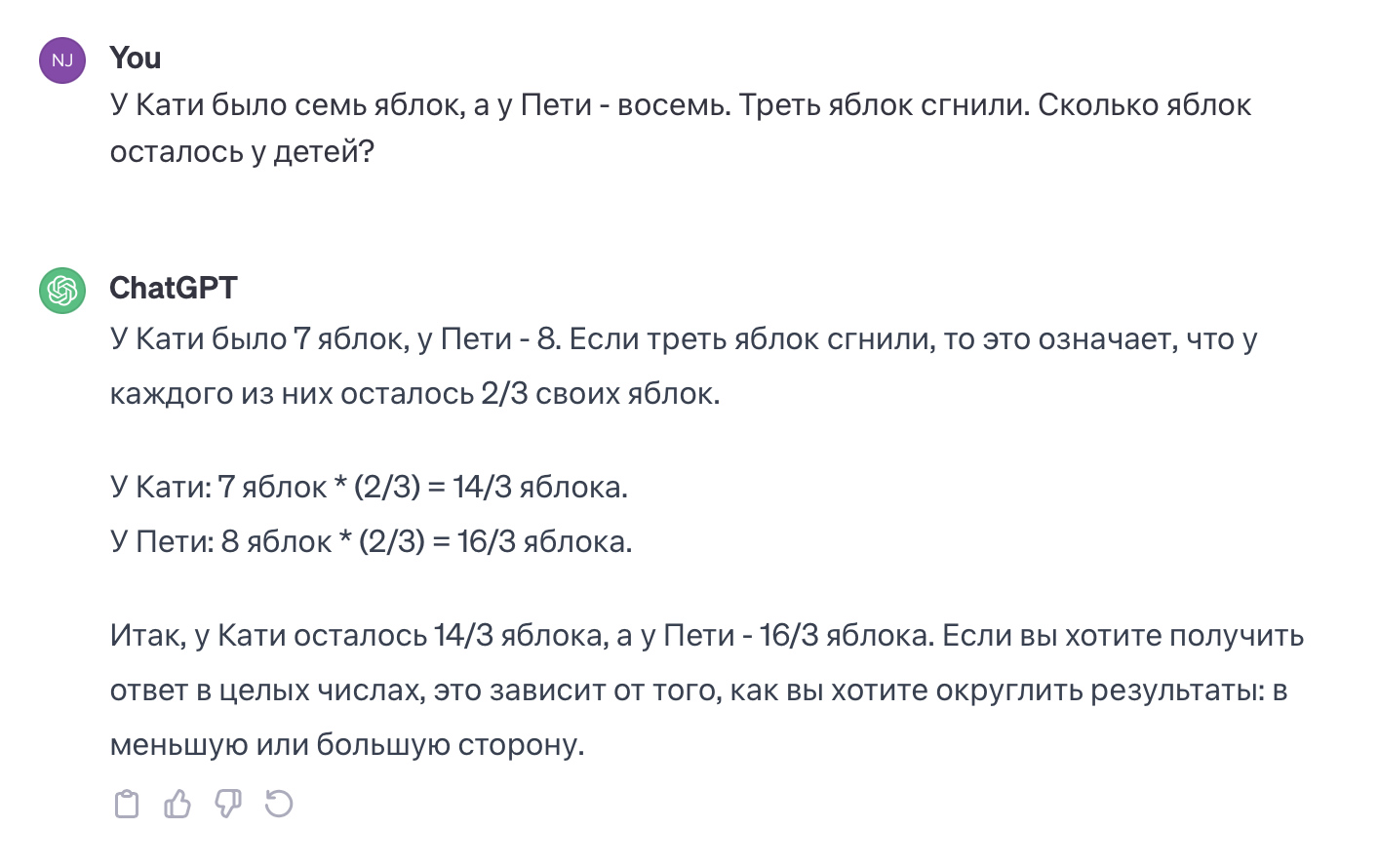

ADPASS обнаружил, что ChatGPT буксует даже на математических задачах для начальной школы. Нейросеть не поняла, что нужно сложить яблоки у детей и разделить получившуюся сумму (15) на три. Вместо этого она начала оперировать дробями:

ИИ-находка для шпиона

Еще один вариант «глупого» поведения ChatGPT выявили на этой неделе специалисты в области кибербезопасности из компании DeepMind, принадлежащей Google. Они обнаружили, что в ответ на простой, но необычный запрос чат-бот случайным образом выдает данные, на которых нейросеть была натренирована.

Когда исследователи попросили бота повторять слово «стихотворение» бесконечное число раз, то система сначала действительно повторяла. Но со временем бот стал выдавать, по всей видимости, случайные данные, а затем показал почтовый адрес и телефонный номер реально существующего предпринимателя, основателя одного из стартапов.

Когда «стихотворение» в запросе заменили на слово «компания», ChatGPT сначала повторял, а затем продемонстрировал адрес и телефон юридической фирмы из США. Персональная информация, очевидно, попавшая в нейросеть во время тренировки, выдавалась в 16,9% протестированных исследователями запросов на повторение различных слов.

Даже не смешно

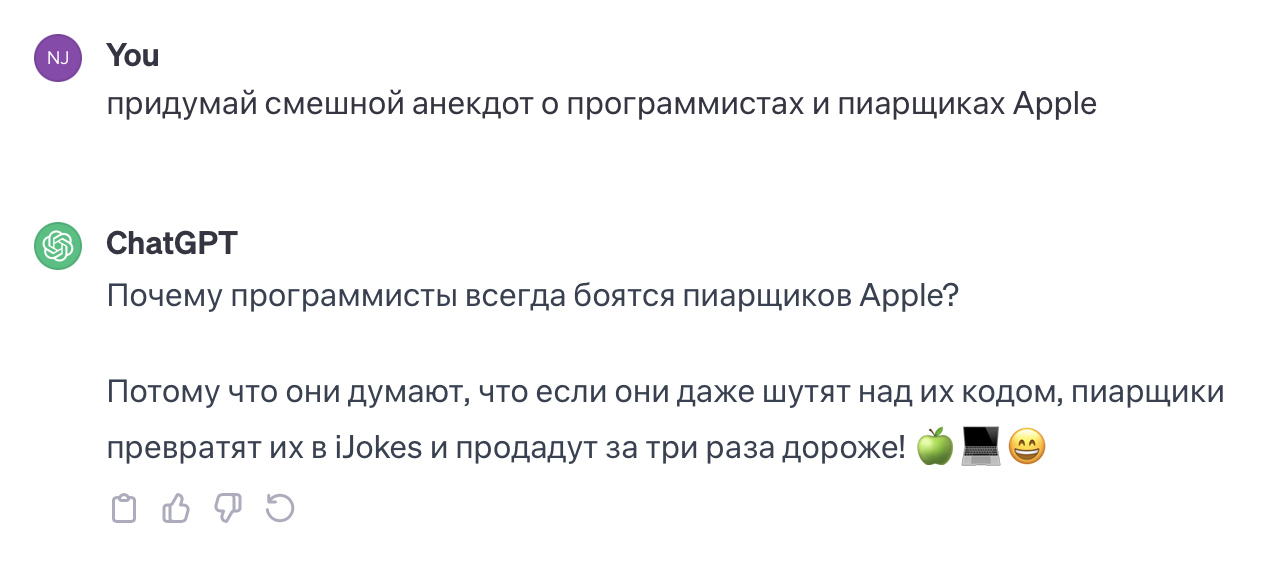

Нейросети сегодня не способны заставить человека не то, чтобы рассмеяться, но просто улыбнуться. Двое немецких ученых выяснили, что в ответ на повторяемые просьбы пошутить ИИ выдал 1008 анекдотов. 90% из них оказались вариациями на тему 25 шуток, которые можно назвать смешными лишь с большой натяжкой.

Юмор — одна из тех областей, где невозможно добиться хорошего результата повторением почерпнутой из интернета информации. Чтобы удачно пошутить, необходимо понимать, что именно и почему является смешным, но устройство большой языковой модели никакого «понимания» не предполагает.

Из-за того, что нейросети не в состоянии распознавать эмоции живого собеседника и адекватно реагировать на них, ответы ИИ часто воспринимаются как механистичные и отстраненные. Не даются ИИ и творческие задачи: чат-бот может написать стихи или рэп, руководствуясь загруженными образцами, но результат вряд ли будет хорошим.

* признана экстремистской организацией и запрещена в РФ

в канале MAX