Фейковые журналисты и ИИ-мошенники: как медиа проигрывают войну искусственным авторам

Иллюстрация сгенерирована Midjourney

Дело Марго Бланшар

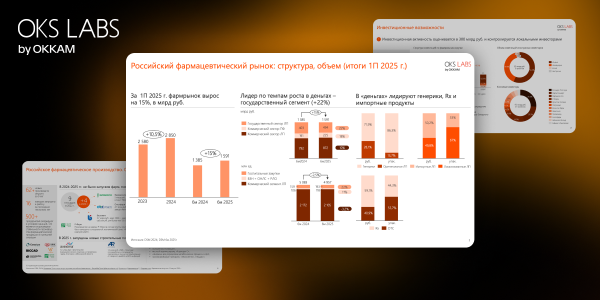

Скандал начался в мае, когда технологическое издание Wired удалило статью о свадьбах в виртуальных пространствах вроде Minecraft спустя несколько дней после публикации. Позже издание признало: материал «не прошел должный процесс фактчекинга и не получил финальную редактуру от старшего редактора».

Сообщения об удалении ИИ-статей на сайтах Business Insider и Wired

Расследование британского издания о медиа Press Gazette выявило, что за именем Марго Бланшар скрывается несуществующий человек. После публикации разоблачения пять других изданий также удалили подписанные этим именем статьи. Business Insider пошел дальше и убрал дополнительные материалы от первого лица других авторов из-за сомнений в их подлинности, то есть масштаб проблемы оказался шире.

Онлайн-детектор ИИ Pangram определил длинное сообщение от аккаунта Марго Бланшар в Press Gazette как созданное искусственным интеллектом с вероятностью 99%. При этом более короткие сообщения определялись как написанные человеком. «Бланшар» сначала отрицала обвинения в использовании ИИ, затем заявила, что фрилансеры «часто используют псевдонимы», а после написала Press Gazette: «мое настоящее имя — Эндрю Фрелон».

Расследование привело к раскрытию цепочки: Марго Бланшар оказалась персонажем Эндрю Фрелона, который в свою очередь является псевдонимом Тима Буше — эксперта по безопасности веб-платформ из Квебека. Канадская телерадиовещательная корпорация CBC News подтвердила личность Буше через скриншоты и видеозвонок в Signal.

Серийный ИИ-провокатор

Профиль Тима Буше раскрывает систематический подход к медиапровокациям. Эксперт по безопасности веб-платформ и политическим вопросам из Квебека ранее заявлял о «написании» 120 книг с помощью ИИ. Он предлагал правительству Канады принять билль о правах ИИ и создавал фальшивые архивные ссылки, а также выпущенные задним числом статьи о несуществующей арт-группе в интернете.

В июле 2025 года Тим Буше устроил еще один скандал, создав аккаунт в X, якобы представляющий ИИ-группу The Velvet Sundown. Он дал телефонное интервью журналу Rolling Stone, выдавая себя за представителя группы, без ведома и разрешения настоящих создателей музыкального проекта. После разоблачения Rolling Stone сообщил, что «называющий себя Эндрю Фрелоном… теперь заявляет в посте на Medium, что проводил сложную мистификацию, нацеленную на медиа».

В посте на Medium, помеченном тегами «сатира» и «фикшн», Фрелон/Буше утверждал, что создал схему с Марго Бланшар для предоставления «крупному медиаклиенту» «практических данных» о том, может ли «полностью автономная ИИ-система выпускать достоверные новостные истории достаточного качества для продажи топовым изданиям». Он описал создание агентной ИИ-системы, способной находить возникающие тренды — или изобретать их — и составлять и отправлять предложения «практически без вмешательства».

«Я хочу показать людям, каково это — это ощущение необходимости определять, что реально, а что нет, что правильно, а что неправильно, или принимать все эти странные решения, которые почему-то становятся вашей проблемой или вашей ответственностью», — объяснил Тим Буше свою мотивацию в интервью CBC News.

Кенийская схема

Параллельно с разоблачением Марго Бланшар главный редактор City AM Magazine Стив Диннен раскрыл другую схему с ИИ-журналистом. Американский писатель Джозеф Уэльс оказался Уилсоном Кахаруа из Найроби. Диннен провел собственное расследование и даже взял видеоинтервью у Кахаруа.

Уилсон Кахаруа предложил Стиву Диннену две темы для статей. Первая — о «странном тренде bed rotting (“гниение в постели”) — вирусной одержимости поколения Z проводить целые дни, лежа в постели, скроллить, перекусывать и полностью впадать в инертность». Главред проигнорировал его из-за банальности. Вторая — о «лондонских войнах жареной курицы» — заинтересовала редактора.

В переписке журналист заметил странности. «Было много странных строк, которые явно не мог написать человек», — рассказал он Press Gazette. Например: «Думайте о Клане Сопрано встречается с Кухонными кошмарами, с гарниром пери-пери» или «Дайте знать, если хотите, чтобы я работал под прикрытием (с дополнительной картошкой фри)».

«Красные флаги» ИИ-контента

— Стилистические маркеры: избыточное использование тире, буллет-поинты в неподходящих местах, чрезмерное выделение текста

— Содержательные признаки: абсурдные трендовые темы («гниение в постели», «тихие танцевальные вечеринки как фитнес»), несуществующие локации

— Коммуникационные сигналы: странные обороты речи, неуместные метафоры, просьбы об оплате необычными способами

— Верификационные проблемы: отсутствие цифрового следа автора, несовпадение платежных данных с именем, использование виртуальных номеров

Верификационные проблемы: отсутствие цифрового следа автора, несовпадение платежных данных с именем, использование виртуальных номеров

-Содержательные признаки: абсурдные трендовые темы («гниение в постели», «тихие танцевальные вечеринки как фитнес»), несуществующие локации-Коммуникационные сигналы: странные обороты речи, неуместные метафоры, просьбы об оплате необычными способами-Верификационные проблемы: отсутствие цифрового следа автора, несовпадение платежных данных с именем, использование виртуальных номеров

— Содержательные признаки: абсурдные трендовые темы («гниение в постели», «тихие танцевальные вечеринки как фитнес»), несуществующие локации-Коммуникационные сигналы: странные обороты речи, неуместные метафоры, просьбы об оплате необычными способами-Верификационные проблемы: отсутствие цифрового следа автора, несовпадение платежных данных с именем, использование виртуальных номеров

Как выяснилось, мошенник платил за подписку на сервис, оповещающий о редакционных запросах на статьи, затем использовал ИИ Deepseek для генерации предложений. Для получения оплаты он использовал фальшивые водительские права, купленные в даркнете, и PayPal-аккаунт, зарегистрированный на имя Джозефа Уэльса. Некоторые компании платили ему в криптовалюте. У него также был американский телефонный номер в резюме, за который он платил $3,99 в месяц.

Сколько стоит стать ИИ-журналистом

Бизнес-модель медиамошенничества оказывается удивительно доступной. Базовые затраты: $3,99 в месяц за американский телефонный номер, фальшивые документы с даркнета (цены варьируются от $50 до $500), подписка на сервисы мониторинга редакционных запросов ($20–100 в месяц), доступ к продвинутым ИИ-моделям ($20–50 в месяц). Итого: начальные инвестиции менее $1000. При средней ставке фрилансера в британских изданиях £200–500 за статью, окупаемость наступает после 2–5 опубликованных материалов. Издания же часто предпочитают сэкономить на фактчекинге: полноценная проверка одной статьи может стоить £100–300 в зависимости от сложности, что составляет значительную часть бюджета на материал.

«Если бы вы были недостаточно умны, это бы прошло, — сказал Кахаруа Диннену. — Я должен пытаться. Я не мошенник, я просто делаю то, что должен, чтобы выжить». Он объяснил, что написал бы историю о куриных магазинах как мог, исследуя тему онлайн и с помощью родственников в Лондоне. Но главред указал, что упомянутые в предложении места, такие как филиал ресторана Chicken Cottage в Стратфорде, не существуют.

До появления ChatGPT Кахаруа получал оплату от крупных копирайтинговых агентств. После революции генеративного ИИ ему пришлось менять тактику выживания.

Кризис редакционных процессов

Главный редактор City AM Magazine Стив Диннен описывает масштаб проблемы: из 300 полученных предложений после его запроса на «странные идеи для статей» большинство оказались непригодными. «Волны непригодного контента — не все созданы ИИ, фактически большинство написано людьми, но все совершенно бесполезно», — говорит он.

Последствия очевидны: редакторы возвращаются к работе только с проверенными авторами. «Вы снова обращаетесь к людям, с которыми работали раньше и которым доверяете, зная, что они не будут использовать ИИ для генерации предложения или написания статьи. Это печально, потому что в итоге остаешься без новых голосов, и в конечном счете это станет проблемой», — объясняет Диннен.

Парадокс ситуации в том, что ИИ одновременно вытесняет реальных авторов из развивающихся стран и становится их единственным инструментом выживания. Кахаруа потерял работу в копирайтинговых агентствах именно после запуска ChatGPT, что заставило его использовать тот же ИИ для создания фейковой журналистской личности.

в канале MAX