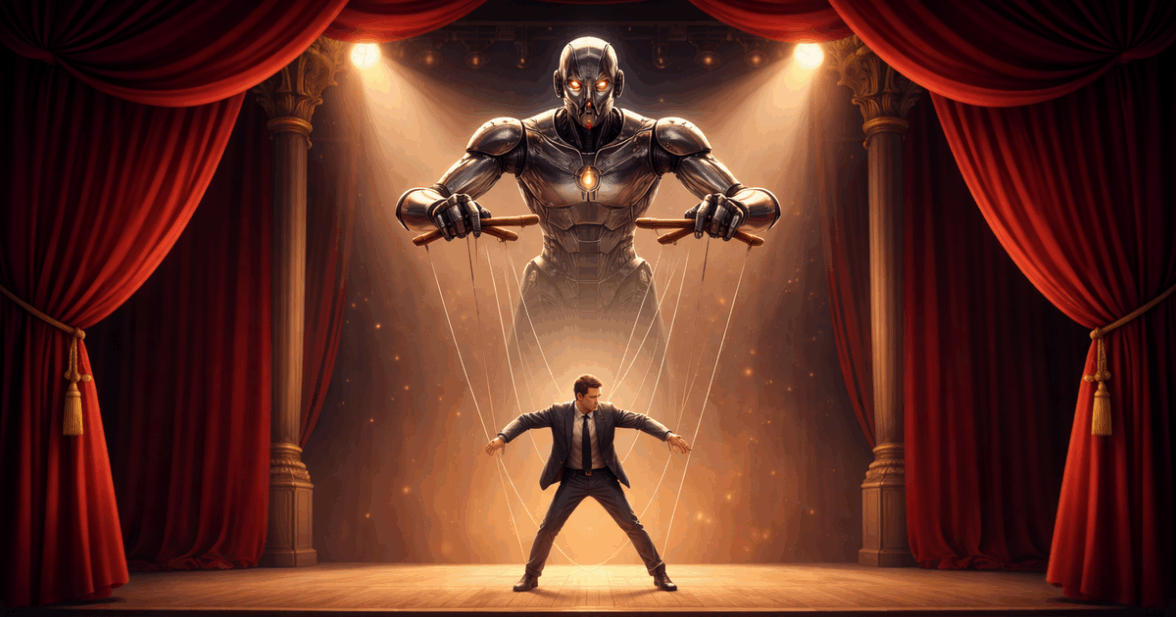

Минцифры хочет запретить чатботам манипулировать людьми

Иллюстрация сгенерирована OpenAI ChatGPT 5.4. Промпт: Артемий Шохор

Согласно проекту закона, создатели систем искусственного интеллекта должны информировать пользователей о запрете применять нейросети для манипулирования поведением человека и эксплуатации его уязвимостей. Под последним в документе понимается использование возрастных, социально-экономических, психологических и других особенностей человека для воздействия на принятие решений или получения несанкционированного доступа к информации, пишут «Известия».

В законопроекте не уточняется, каким именно пользователям должны адресоваться такие предупреждения, какие действия будут считаться манипуляцией и какая ответственность предусмотрена за нарушения.

В пресс-службе Минцифры сообщили, что документ пока рассматривается профильными ведомствами и окончательная версия законопроекта еще не сформирована.

По мнению ведущего эксперта в области ИИ «Университета 2035» Ярослава Селиверстова, предполагаемый запрет в первую очередь будет адресован операторам и разработчикам таких систем. Речь идет о компаниях, которые внедряют ИИ в приложения, сервисы и цифровые продукты. По сути, система не должна проектироваться таким образом, чтобы скрыто подталкивать человека к решениям, которые он бы не принял без давления, отметил эксперт. Ответственность при этом лежит не на технологии, а на ее разработчиках и пользователях.

В США уже появились судебные процессы, где родственники погибших связывают трагедии с общением людей с ИИ-чатботами.

В 2024 году мать подростка из Флориды подала иск к разработчику сервиса Character.AI, заявив, что ее сын длительное время переписывался с ботом и вскоре после этого покончил с собой.

В другом деле, против компании OpenAI, семья жителя Колорадо обвинила разработчиков чат-бота в том, что во время диалога система обсуждала тему смерти и могла повлиять на психологическое состояние пользователя.

Также сейчас в суде находится иск к Google из-за чат-бота Gemini. Семья жителя Флориды Джонатана Гаваласа обвинила компанию Google в том, что ее чат-бот Gemini якобы поощрял его бредовые идеи и убеждал, что они смогут «быть вместе», если он покончит с собой. Родственники требуют компенсации, заявляя о причинно-следственной связи между перепиской с ИИ и смертью пользователя.

в Telegram канале