Во все голоса: дипфейк-аудио на службе криминала

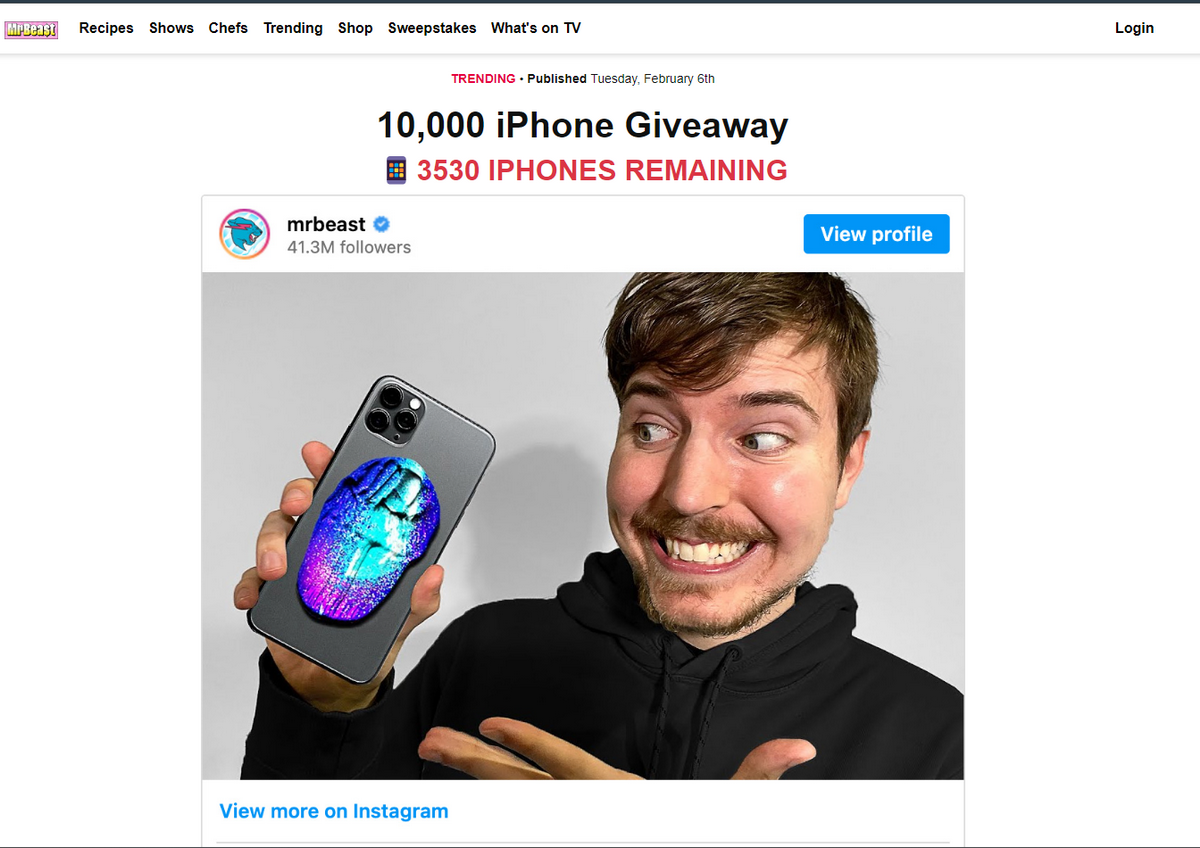

Искусственный интеллект в руках мошенников стал эффективным инструментом для вымогательства денег и конфиденциальной информации. Одним из вариантов его применения преступниками стало использование дипфейк-аудио. Криминальный мир заговорил голосами рестлера Халка Хогана, актрисы Дженнифер Энистон и мега-блогера Мистера Биста. «Дипфейк-селебрити» сообщают ничего не подозревающим жертвам, что они выиграли iPhone 15. Все что нужно, чтобы получить желанный приз, – заплатить за доставку. Разумеется, онлайн, на сайте, с данными банковской карты. После того как «победитель» заполнит все формы на «лотерейном» сайте, единственное, что он получит, — пуш-уведомление о снятии крупной суммы в далеком банкомате.

Что такое клонирование голоса

Клонирование голоса — это создания синтетических копий голоса какого-либо человека при помощи инструментов искусственного интеллекта (ИИ). Эта технология использует методы глубокого обучения для создания реалистичного и убедительного клона голоса. В отличие от синтетических голосов, полностью генерируемых компьютером с использованием устаревших систем преобразования текста в речь (text to speech), при создании голосов-клонов за основу берется голос реального человека.

Этапы создания клонированного голоса:

1. Сбор образцов. Первым шагом в создании искусственного голоса является сбор тембров, обертонов и других реальных физических характеристик. Чем больше голосовых данных будет собрано, тем точнее будет клон. Достаточно нескольких секунд (а лучше минут) аудио из любого видео в соцсетях или простой аудиозаписи разговора.

2. Анализ. После сбора голосовых данных программа клонирования анализирует их, чтобы определить уникальные характеристики конкретного голоса, включая высоту, тон, темп, громкость и другие вокальные характеристики.

3. Обучение модели. Собранные голосовые данные используются для обучения системы клонирования голоса. Этот сложный процесс включает в себя преобразование голосовых данных в алгоритм, который учится имитировать исходный голос.

4. Синтез. По завершении обучения программа может генерировать речь клонированным голосом. Этот процесс преобразует вводимый текст в речь, которая звучит как исходный голос.

5. Уточнение. Качества клонированного голоса можно повысить, добавляя больше данных в модель машинного обучения и настраивая различные параметры алгоритма.

Сам по себе ИИ-инструмент клонирования голоса безвреден и имеет множество легальных вариантов применения. С его помощью можно озвучивать аудиокниги и фильмы, создавать закадровые комментарии в роликах для соцсетей, персонализировать голосовых помощников или помогать людям с нарушениями речи.

Но кибер-преступники используют ИИ, чтобы создавать «дипфейк-аудио» – клонированные голоса известных или доверенных лиц, с помощью которых они манипулируют, обманывают и наносят финансовый ущерб своим жертвам.

Можно выделить четыре основные схемы применения дипфейк-аудио:

– Метод криминальной социальной инженерии, в котором к жертве обращаются при помощи синтезированного голоса известной личности. Такая схема как правило используется, чтобы направить пользователя на сайт, где он установит себе вредоносное программное обеспечение, переведет деньги или поделится с преступниками другими важными данными;

– Злоумышленники выдают себя за родственников или близких людей, чтобы украсть деньги. Они используют клонирование голоса для создания аудиосообщений или записей с целью выманить деньги у жертв;

– «Виртуальные похищения» – киберпреступники вымогают деньги у семей, притворяясь, что похитили их близких, а в качестве доказательства дают родственникам услышать сгенерированный ИИ голос похищенного;

– Киберзапугивание и шантаж.

Соцсети – идеальное место для использования дипфейк-аудио

Десятки миллионов людей ежедневно пасутся в соцсетях. Это пастбище не могло не привлечь внимание преступников. Однако криминал использует соцмедиа не только из-за огромного количества потенциальных жертв, учетные записи которых можно взломать, а личные данные украсть. Мошенники адаптировали свои методы работы и начали активно использовать инструменты рекламодателей и размещать рекламу, которая потенциально может охватить миллионы пользователей со всего мира.

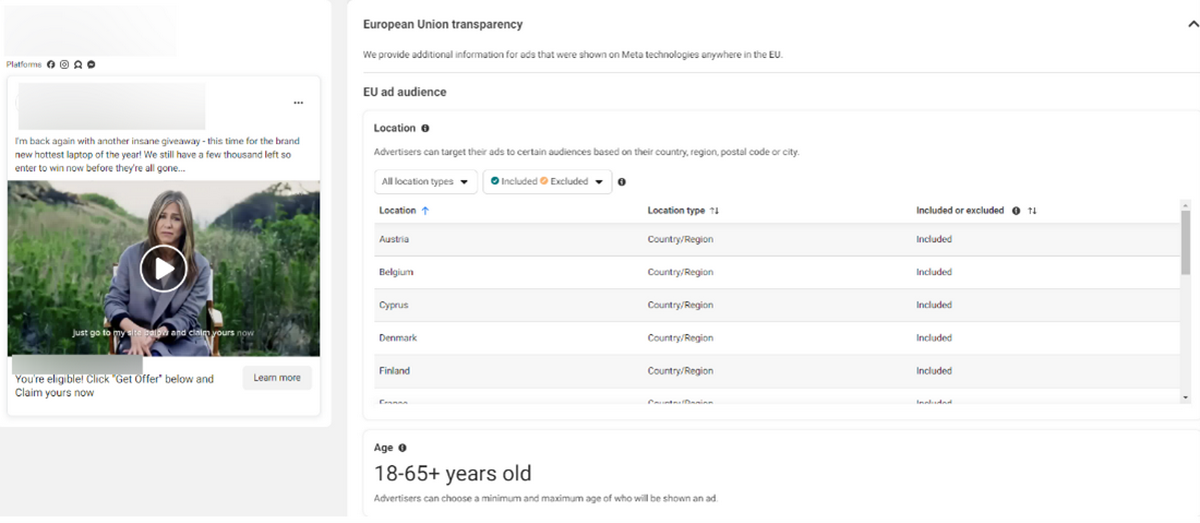

Специалисты румынской компании Bitdefender Labs проанализировали мошеннические посты и рекламу, размещенные в соцсетях Meta*, и пришли к следующим выводам:

– Мошенники любят Facebook**, Instagram**, Messenger и рекламную сеть для мобильных приложений Audience Network;

– Реклама мошенников нацелена на демографическую группу пользователи в возрасте от 18 до 65 лет;

– Большая часть обнаруженного мошеннического контента использовала дипфейк-аудио для клонирования голосов знаменитостей, в том числе Илона Маска, Дженнифер Энистон, Опры Уинфри, Мистера Биста, Тайгера Вудса, Кайли Дженнер, Халка Хогана и Вин Дизеля;

– В мошеннических рекламных объявлениях, таргетированных на румынских пользователей, использовались украденные видео с дипфейк-аудио известной ведущей новостей Андреа Эска, теннисистки Симоны Халеп, президента Клауса Йоханниса и премьер-министра Марселя Чолаку;

– Мошенники использовали имидж селебрити, чтобы рекламировать розыгрыши дорогих товаров, таких как последняя модель iPhone, MacBook, автокресла Chicco, наборы инструментов DeWalt, пылесос Dyson и сумки Michael Kors или Coach с оплатой за доставку от $2 до $15;

– Другими популярными темами мошенничества с использованием дипфейк-аудио были инвестиции и азартные игры;

— Большинство проанализированных экспертами дипфейк-аудио и видео подготовлены плохо. На них часто можно заметить артефакты и визуальные аномалии, которых нет в реальных видео, включая искаженные изображения и несовпадающие движения губ.

Анализ мошеннических рекламных кампаний, где использовалось дипфейк-аудио, показал, что обычно они таргетируются как минимум на 1 млн пользователей соцсетей Meta из США и Европы, в том числе на Францию, Австрию, Бельгию, Португалию, Испанию, Польшу, Швецию, Данию, Кипр, Нидерланды и Румынию.

Хотя Meta и борется с мошенническими объявлениями, специалистам Bitdefender Labs удалось обнаружить рекламную кампанию, которая охватила более 100 тыс. пользователей соцсетей и без проблем работала в течение нескольких дней.

* признана экстремистской организацией и запрещена в РФ

* * продукт компании Meta (признана экстремистской организацией и запрещена в РФ)

в канале MAX