ИИ врет: В эпоху нейросетей многие подростки не доверяют фейковому контенту и бигтеху

Подростки часто сталкиваются с фейковым контентом

В какой степени генеративный ИИ влияет на доверие подростков к информации, лежащей в основе нашего взаимодействия и понимания окружающего мира и самих себя? Ответу на этот вопрос посвящено исследование, подготовленное Common Sense Media, основанное на данных опроса американских подростков.

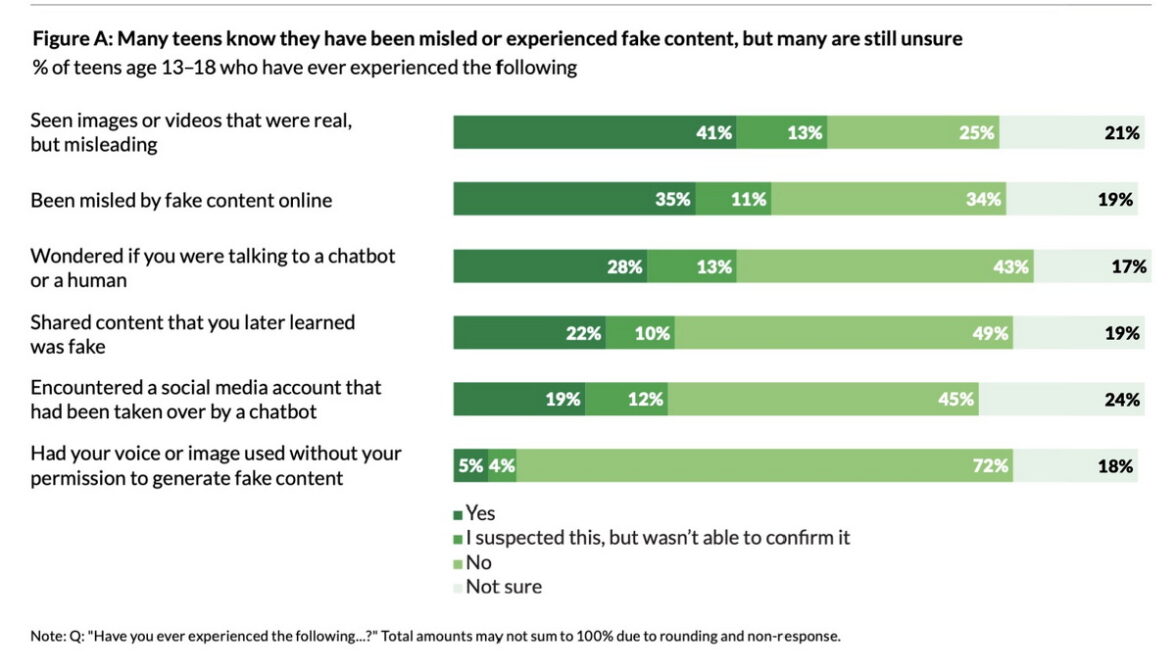

41% опрошенных заявили, что им попадался фейковый контент — фотографии или видео, которые выглядели настоящими, но вводили в заблуждение. Еще 13% ответили, что какой-то контент вызывал у них подозрение, но они не смогли проверить свои догадки. Только каждый четвертый (25%) сказал, что не сталкивался с подобным. Остальные (21%) были не уверены в ответе.

Каждый третий подросток (35%) признался, что его сбил с толку ложный контент. Еще у 11% есть подобные подозрения.

28% респондентов сталкивались, а 13% возможно сталкивались с ситуацией, когда им было непонятно, с кем они общаются — с человеком или чат-ботом.

22% опрошенных делились, а еще 10% возможно делились контентом, который, как впоследствии выяснилось, был фейковым.

19% (и, возможно, еще 12%) наталкивались на аккаунт в соцсети, захваченный чат-ботом.

Голос и фото 5% опрошенных (и, возможно, еще 4%) использовались для создания фейкового контента.

Фейки подрывают доверие к онлайн-контенту

Подавляющее большинство подростков, столкнувшихся с фейковым контентом в той или иной форме, изменили свой подход к информации в онлайне и стали проверять, насколько она точна и соответствует действительности. В зависимости от того, какой именно тип фейкового контента стал причиной изменения поведения, процент решивших проверять информацию, колеблется от 67% до 72%.

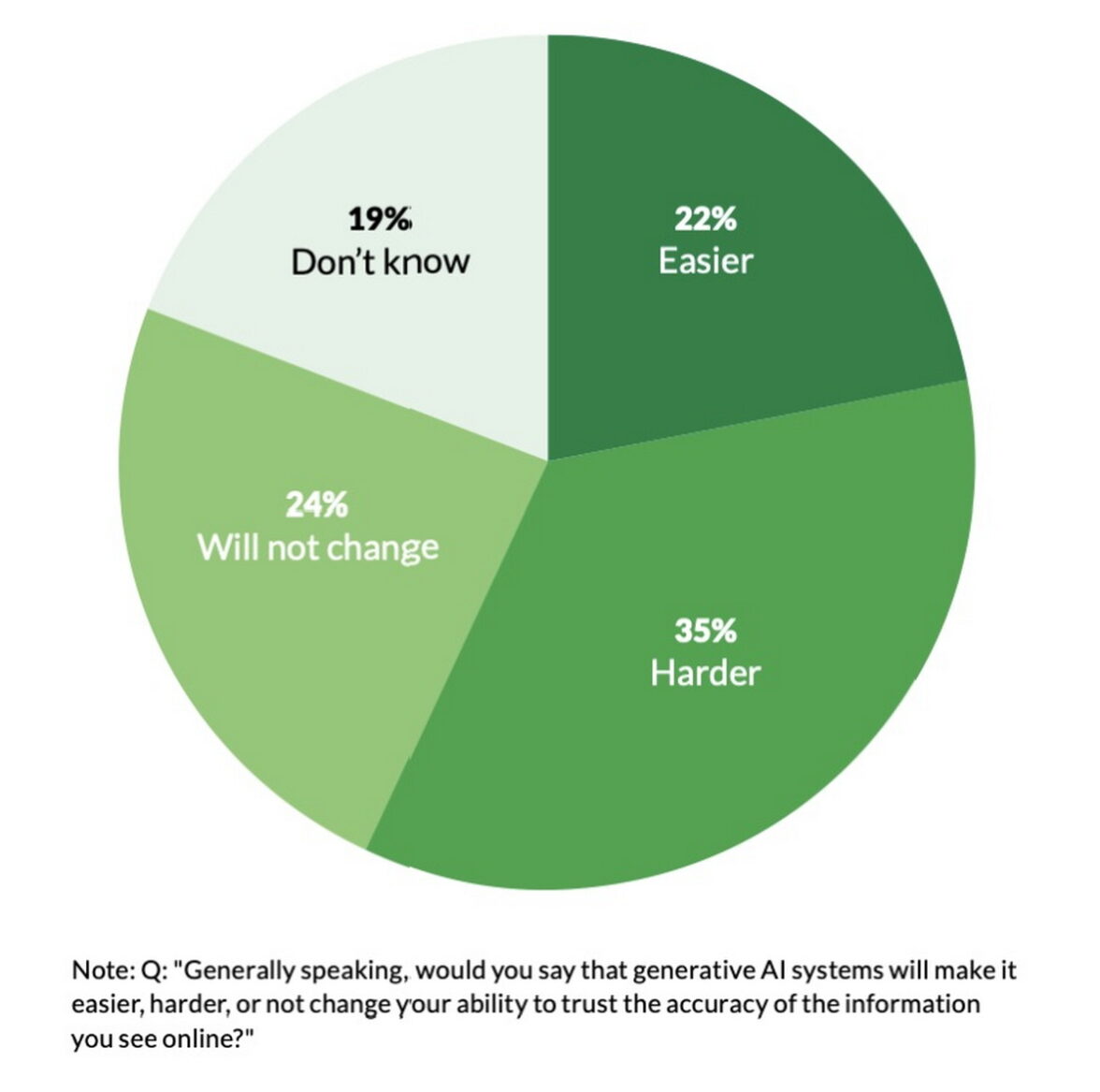

35% подростков считают, что из-за развития систем генеративного ИИ онлайн-информации стало сложнее доверять. Еще 24% полагают, что генеративный ИИ ничего не изменил. 22% думают, что благодаря чат-ботам им стало проще доверять онлайн-информации. 19% не уверены, как генеративный ИИ повлиял на точность информации.

Генеративный ИИ создает проблемы в школе, но не всем

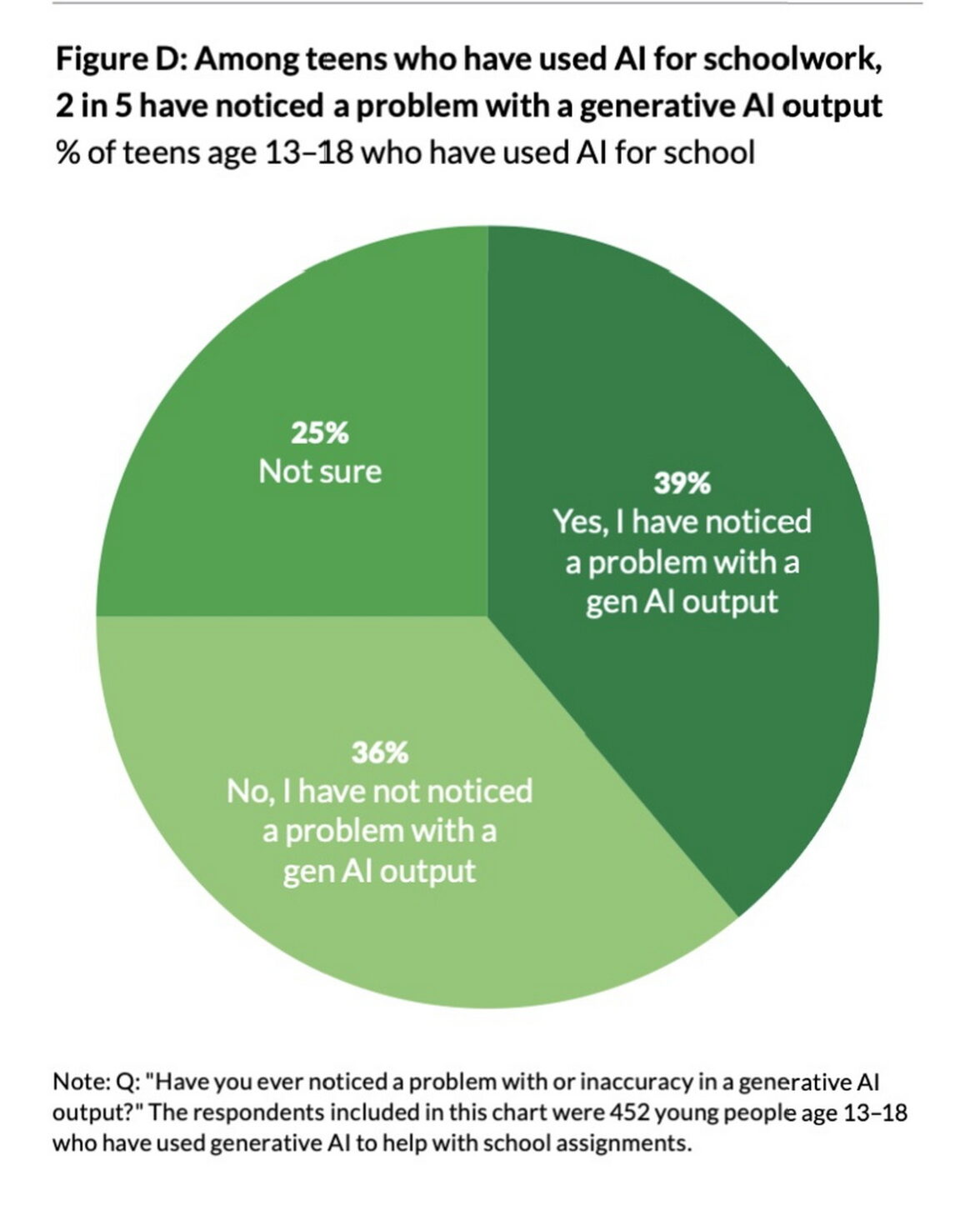

Примерно четверо из десяти подростков (39%), использовавших генеративный ИИ при выполнении домашней работы, столкнулись с тем, что нейросеть врет. Подростки обнаружили проблемы или неточности в выдаче ИИ. 36% использовавших возможности искусственного интеллекта таких проблем не заметили. 25% не смогли определиться в вопросе о том, создает ли ИИ фейковый контент.

Полученный результат указывает на необходимость как улучшить качество работы ИИ, так и научить подростков критически оценивать созданный с помощью ИИ контент, в том числе контент, созданный в образовательных целях.

Большинство подростков не доверяет ведущим технологическим компаниям

Примерно шесть из десяти подростков считают, что ведущим технологическим компаниям (Google, Apple, Meta*, TikTok, Microsoft и т.д.) нельзя доверять в вопросе заботы о душевном здоровье и благополучии пользователей (так ответили 64% респондентов). В то, что эти компании будут защищать безопасность пользователей, если это нанесет ущерб их прибылям, не верят 62% опрошенных.

53% пользователей не верят, что IT-гиганты будут принимать этичные и ответственные решения, касающиеся дизайна их продуктов. 52% не верят, что крупные технологические компании будут надежно защищать персональные данные.

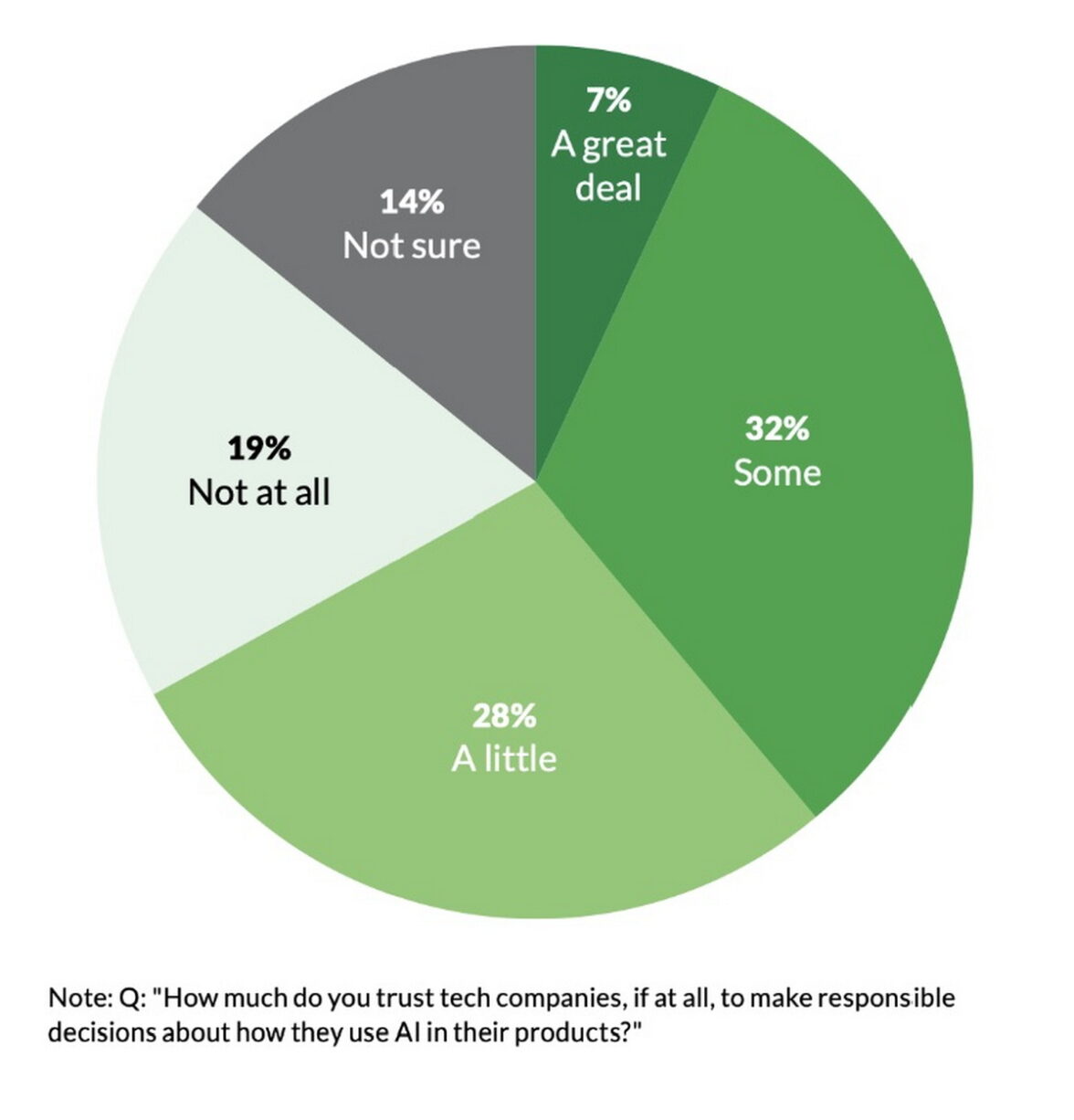

В вопросе, насколько можно доверять бигтеху в принятии ответственных решений по использованию ИИ, мнения разделились. 19% считают, что доверять нельзя вообще. 32% полагают, что в какой-то степени можно доверять. 28% думают, что доверять можно, но чуть-чуть. Полное доверие выразили лишь 7% опрошенных. А 14% оказались не уверены в ответе.

Чего же хотят подростки от ИИ? Три четверти опрошенных (74%) полагают, что очень важными вопросами являются защита конфиденциальности и прозрачность. Такое же число опрошенных заявили, что платформы генеративного ИИ не должны поощрять людей делиться личной информацией. 73% подростков высказались за то, чтобы созданный с помощью ИИ контент специально отмечался или снабжался водяными знаками.61% считают, что создатели контента должны получать компенсацию за обучение ИИ на таком контенте.

Common Sense Media

Common Sense Media (CSM, Common Sense) — американская некоммерческая организация. Основана в 2003 году. Основатель и генеральный директор — Джим Стейер. Основные направления деятельности: составление рейтингов фильмов, телепередач, подкастов, книги и других продуктов, связанных с развлечениями, с позиций оценки их пригодности для детей; разработка рекомендаций и образовательных материалов по использованию технологий в школьном образовании; финансирование исследований о роли средств массовой информации и технологий в жизни детей.

Как проводилось исследование

Данные исследования были получены в ходе общенационального репрезентативного опроса, в котором приняли участие 1045 взрослых граждан США (в возрасте 18 лет и старше), являющихся родителями или опекунами одного или нескольких подростков в возрасте от 13 до 18 лет, а также их дети-подростки (только один ребенок каждого родителя или опекуна). Все 18-летние респонденты все еще учились в средней школе. Опрос проводился онлайн на английском или испанском языке с марта по май 2024 года. Проведением опроса занималась компания Ipsos Public Affairs по заказу CSM.

* признана экстремистской и запрещена в РФ

в Telegram канале