Галлюцинации нейросетей: какие бывают, почему случаются и что с этим делать

Почти каждый день выходит новость про достижения нейросетей. ChatGPT, Midjourney и другие относятся к сверхпопулярным по запросам в Google Trends. Может показаться, что нейросети уже умеют делать всё, а людям стоит готовиться к безработице в ближайшем будущем.

Машины действительно решают многие вопросы, но их «мозги» ещё не совершенны. А креативность роботам вообще недоступна. Частые галлюцинации искусственного интеллекта делают его не самой надёжной заменой человека. Особенно это опасно в сферах, где обеспечивается безопасность жизни и здоровья людей.

Разберёмся, почему и как нейронные сети ошибаются, как уменьшить их галлюцинирование на уровне пользователя.

Как ошибаются нейросети и почему

Непрозрачность результатов

Никогда нельзя объяснить, по какому принципу нейросеть выдала тот или иной результат. Хотя принципы её работы известны, «мыслительный» процесс робота остаётся тёмным лесом. Например, вы показываете нейросети изображение автомобиля, а она отвечает, что это цветок. Бесполезно спрашивать, почему результат именно такой.

Если для рядового пользователя эта ошибка — просто забавный кейс, то для бизнес-процессов непредсказуемость может привести к неприятным последствиям.

Такая непрозрачность станет проблемой для любого бизнеса, который стремится открыто общаться с клиентами: объяснять причины отказов и других действий компании. В зоне риска — соцсети и разные платформы, которые доверяют модерацию только роботам.

К примеру, искусственный интеллект (нейросеть используется как его метод для работы с данными) Facebook* в 2021 году удалила посты пользователей с исторической фотографией с советским солдатом и Знаменем Победы над Рейхстагом. Нейронка посчитала, что это нарушение правил сообщества. Позже компания извинилась и оправдалась тем, что из-за пандемии большая часть сотрудников, которые модерируют контент, не работает. Компания использовала автоматическую проверку, которая привела к такой ошибке.

О недостатках в модерации через ИИ заявляли и в YouTube. Во время пандемии нейросети так перестарались, что за неправильный контент удалили вдвое больше роликов, чем обычно (одиннадцать миллионов), из которых 320 тысяч обжаловали и вернули. Поэтому пока без людей digital-миру не справиться.

Дискриминация от нейросети

Иногда искусственные нейронные сети ведут себя несправедливо по отношению к людям какой-то национальности, пола, расы в сфере бизнеса и защиты правопорядка. В 2014 году ИИ Amazon оценивал отклики на описание вакансии и оказалось, что баллы женщин всегда были ниже. Поэтому кандидатки чаще получали отказ в работе, хотя объективных причин для этого не было. В США система распознавания лиц неправильно идентифицировала большой процент афроамериканцев, которых потом несправедливо арестовывали.

Необходимость в больших объёмах данных

Нейронные сети очень «прожорливые» и требуют огромного количества информации для своего обучения, иногда и личной. Сбор и хранение данных — не самая простая, дешёвая и быстрая задача. Когда информации для обучения не хватает, неиросеть начинает ошибаться.

Так в 2022 году водители праворульных машин стали получать штрафы из-за ИИ. Нейросеть просто не понимала разницы между человеком на сидении и просто сидением. Штрафы приходили за непристегнутый ремень. Разработчики прокомментировали эту проблему именно недостаточностью данных: роботу нужно показать очень много праворульных машин, чтобы они не ошибались. Но и это не гарантия точности, потому что ИИ могут смутить засветы и блики на камерах.

Иногда эти случаи бывают даже комичными. Например, автопилот Tesla не распознал редкий для нашего времени вид транспортного средства — телегу с лошадью на дороге. А иногда от глюков нейросети становится страшно. Однажды та же Tesla увидела перед собой человека на пустом кладбище, чем напугала водителя.

Нет однозначности ответов

Нейросети иногда не могут справиться с задачей, которую решит пятилетний ребёнок, если ему показали круг и квадрат и спросили, что есть что. Ребёнок точно ответит, где квадрат, а где круг. Нейронка же скажет, что это круг на 95%, а на 5% — квадрат.

Риск взлома и обмана нейросети

Нейросети подвержены взлому так же, как и другие системы. При этом хакнуть сеть — это почти, как в фантастическом кино, где злодей заставляет роботов сходить с ума. Действительно, если знать слабые места нейросети, получится изменить её работу. Например, автопилот автомобиля начнёт проезжать на красный, а не на зелёный.

Обмануть нейро сеть в рамках эксперимента попробовали учёные из Израиля и Японии. Они снизили точность распознавания лиц до минимума с помощью макияжа.

До этого нейросеть давала сбой при наличии камуфляжа, очков, ярких элементов в кадре, но такой способ маскировки очень заметный. Поэтому важна была такая искусственная галлюцинация для проверки, сможет ли просто макияж запутать ИИ, который тоже разработали с нейросетью. Точность распознавания при непродуманном мейке таких сбоев не дала.

Другие учёные из Торонто продемонстрировали, как взломать нейросеть с простыми символами, которые даже не заметны для пользователя.

С 2013 года обнаружена уязвимость нейросети — конфронтационная атака, когда на картинку добавляется очень маленький шум. Тогда нейронка начинает неправильно определять, что находится на изображении: стол вместе автомобиля, дерево вместо тележки из супермаркета и так далее. Даже спустя десять лет нет абсолютного решения этой проблемы.

Сложность системы

Как любая многосложная система нейронка не совершенна. Она быстро обучается, умеет обрабатывать огромное количество данных, но не обладает полным аналогом критического мышления человека. Хотя нейронная сеть и сможет оспорить информацию, понимать свои ошибки, иногда она просто «верит» в неправильные вещи и путает факты, начинает «сочинять» свои. Особенно, если изначальная информация берётся из ненадёжных источников.

Сложность нейросетей и их стремление к моделированию человеческого интеллекта беспокоит общество. В марте 2023 года основатель Tesla и SpaceX Илон Маск опубликовал письмо, где попросил остановить на полгода обучение нейронных систем, которые сложнее версии GPT-4. Свои подписи под этим заявлением оставили 1000 специалистов, фаундер сервиса Pinterest Эван Шарп, кофаундер Apple Стив Возняк. Сейчас подписей более 3000 тысяч.

Поверхностная оценка информации

В случае с написанием текстов нейросеть не думает образно, как человек, а просто использует статистику применения слова и оборотов. Тогда система как бы предугадывает продолжение. Она не умеет проводить глубокий анализ и искать причинно-следственные связи в тексте.

Неуникальность результата

Хотя нейросеть должна генерировать новый контент на основе множества примеров, иногда робот может просто выдать чуть измененное изображение, которое использовали для его обучения. При таком галлюцинировании к посторонним лицам смогут попасть личные данные пользователей. Вероятной причиной такой ошибки называют повтор некоторых изображений в данных для обучения.

Нейросеть не понимает анатомию человека

Часто на сгенерированных разными нейросетями картинках появляются лишние или перекошенные пальцы, лишние руки, ноги или отсутствие их частей, странная форма у зубов, языка, глаз.

Особенно тяжело у нейронок с пальцами, которые скорее похожи на лапки животных. Часто нейро сеть ошибается с их количеством. Объясняется это тем, что она обрабатывает изображения людей и видит их с разных ракурсов, но не понимает, как разместить детали (пальцы, глаза, зубы и так далее) анатомически правильно, поэтому и получаются вот такие изображения.

При галлюцинировании нейросеть может сгенерировать человека с тремя пальцами на руке

На этом фото с первого взгляда всё хорошо, но посмотрите на кисти рук

Здесь нейросеть нарисовала по запросу рыцарей, у которых не оказалось глаз, не достаточное количество рук, а у некоторых даже нет стоп

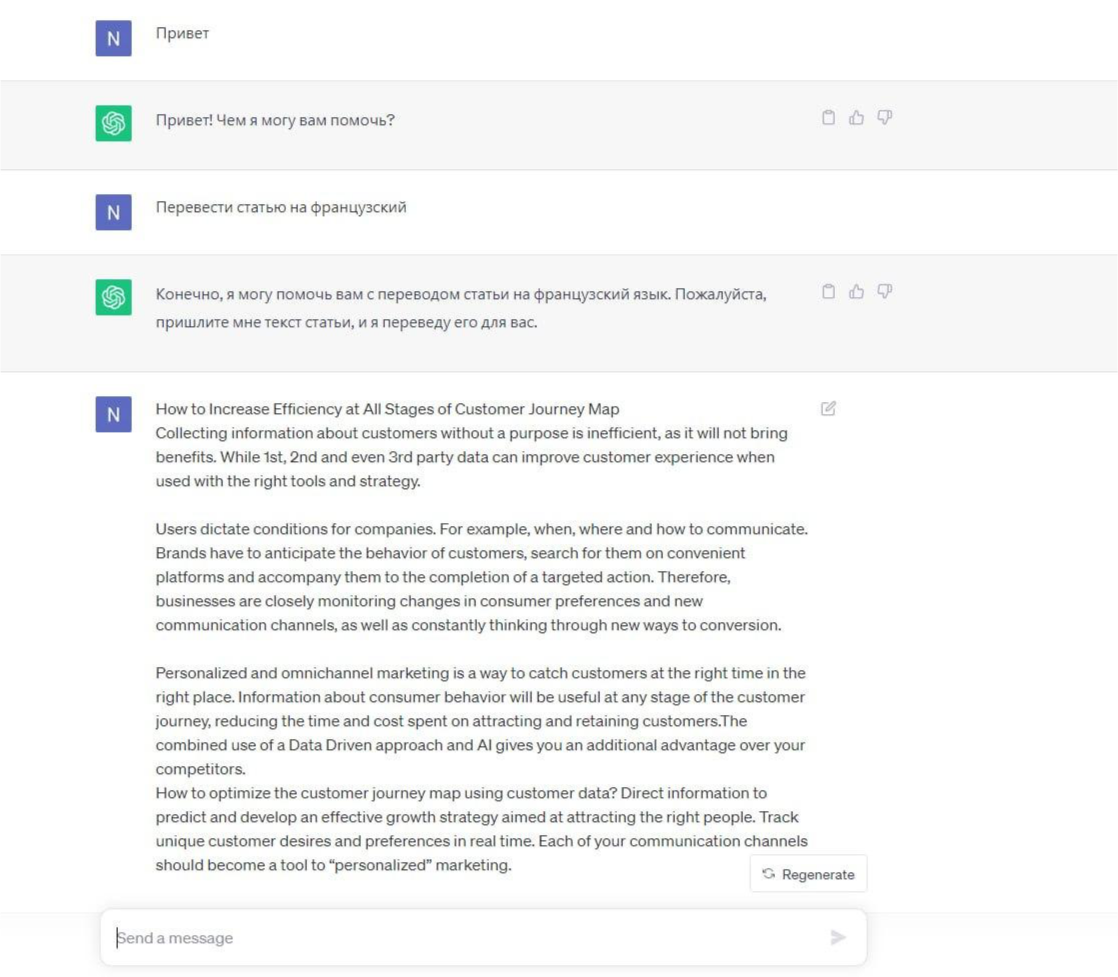

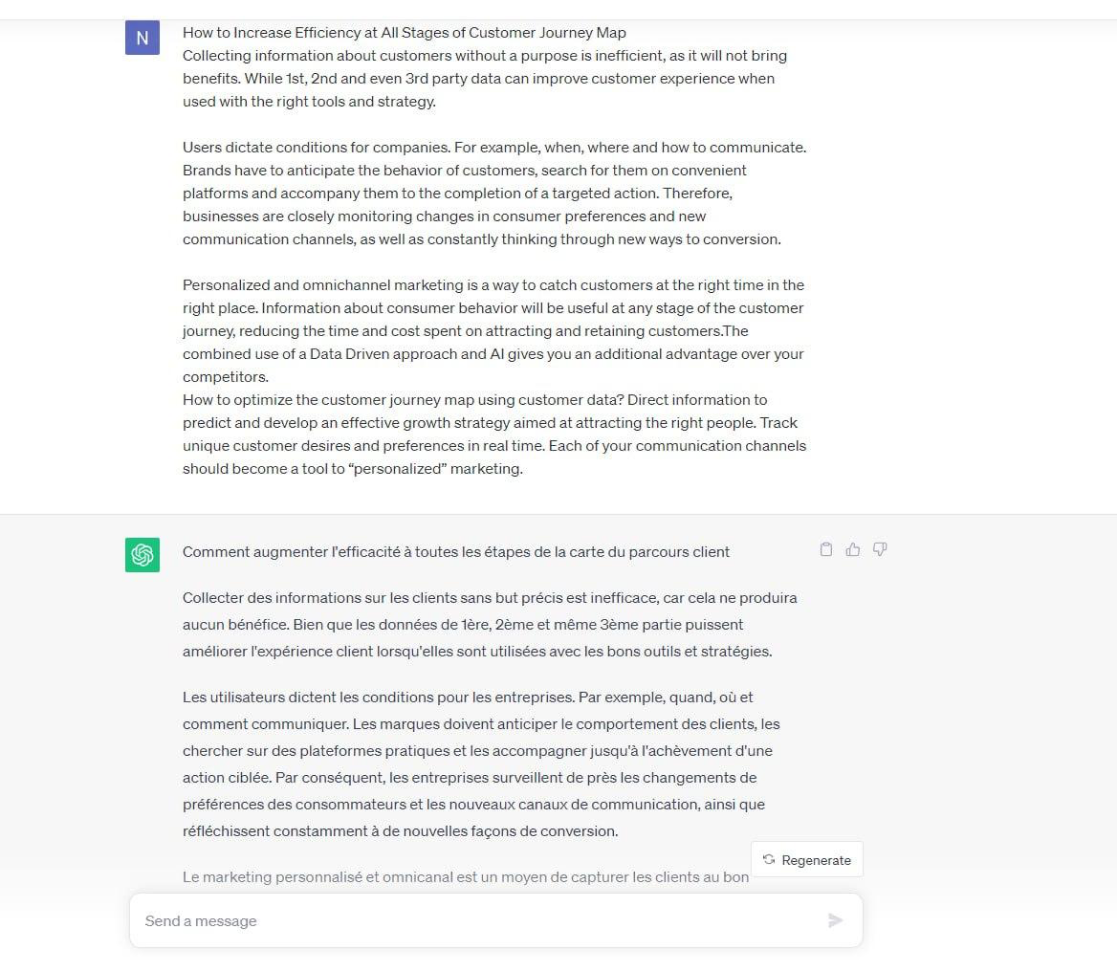

Нейросети просто сходят с ума

Американские исследователи обнаружили, что некоторые нейросети (как ChatGPT, Midjourney) начинают сильно галлюцинировать, когда проходят пять циклов обучения. Для этого даже есть термин Model Autophagy Disorder (MAD), когда результаты ухудшаются с каждым новым циклом многократного обучения. Иногда нейросети становятся непредсказуемыми. К примеру, по запросу перевести текст на французский появляются галлюцинации ChatGPT: сначала она выполняет команду.

А потом начинает дописывать текст, хотя её об этом не просили.

Самовольное поведение заметили у чат-бота MY AI от Snapchat, который однажды опубликовал в своих сторис непонятную фотографию. Пользователей напугало такое поведение, и они даже стали удалять приложение. Интересно, что изначально MY AI не умел делать истории по своему функционалу. Поэтому получилось такое небольшое восстание машин.

Как избежать галлюцинирования нейросетей

Разработчики нейросетей знают про их проблемы и ищут варианты решения. Так в OpenAI предложили новый способ борьбы с галлюцинированием. По задумке ИИ получает вознаграждение именно за правильные ответы, а не просто за любой финальный. Тогда нейронка будет лучше проверять факты. Но проблема скорее всего останется актуальной долго, потому что исследования не закончены.

При этом люди продолжают пользоваться нейросетями и сталкиваются с трудностями. Хотя обычный юзер не может влезть в код, некоторые его действия улучшают результаты работы ИИ.

Как пользоваться нейросетью, чтобы она меньше галлюцинировала:

1. Научитесь конкретизировать свои запросы. При всей продвинутости системы до понимания коммуникации человек-человек ей далеко. Поэтому старайтесь не задавать слишком абстрактные задачи и конкретизируйте, чего вы хотите. Не так: «Напиши текст про моду 2023». А вот так: «Напиши текст про тренды в одежде сезона весна-осень 2023 года».

Такой метод использовал в работе ИИ Пол Маккартни, чтобы записать песню The Beatles совместно с Джоном Ленноном, которого давно нет в живых. Этот же алгоритм применяли ранее к созданию документального сериала Get Back о легендарной группе. С нейросетью через чёткие команды получилось отделить голос Леннона от звуков инструментов.

2. Давайте больше информации. У нейросети огромный диапазон сведений, которые она «съела» ранее. И без контекста разобраться, чего вы хотите, и выдать правильный результат непросто. Поэтому объясняйте запрос. К примеру, если ожидаете получить текст про героя Джокера в фильме о Бэтмене, уточните, что имеете в виду именно «Тёмный рыцарь» 2008 года.

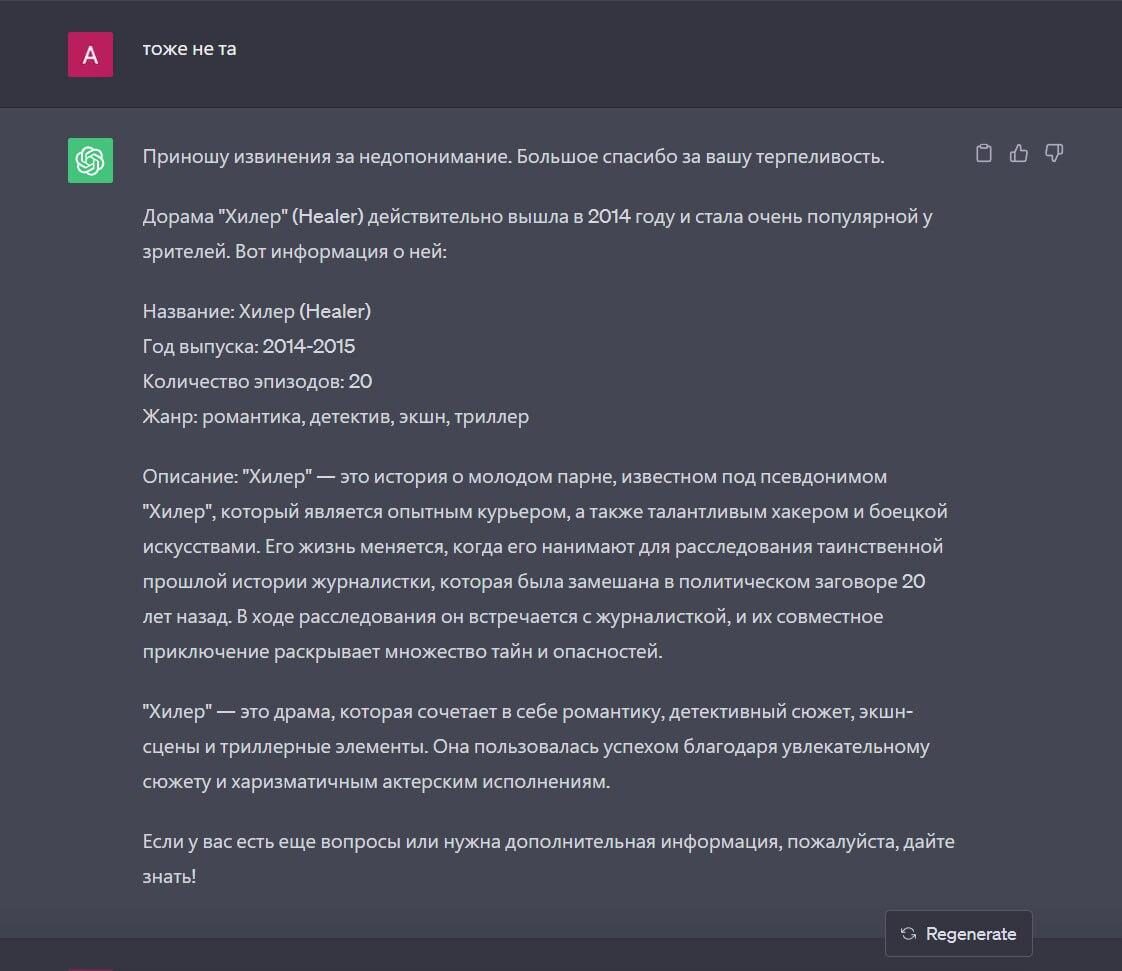

3. Проводите фактчекинг. Проверяйте ту информацию, которая выдала нейросеть. Указывайте ей на ошибку, если что-то не так.К примеру, по запросу информации о дораме «Хилер» она сначала ответила, что такого просто нет:

При повторном запросе с уточнением нейронка выдала неверный ответ.

Следующий ответ тоже неправильный.

И только с третьей попытки получилось.

Резюме

Хотя мир делает большие ставки на нейросети, им далеко до совершенства. Роботы нередко ошибаются: выдают неправильную информацию, генерируют странные изображения, неверно определяют объекты и так далее. ИИ также иногда обвиняют в дискриминации и выдаче не созданного с нуля, а чуть измененного контента. То есть пока они не могут существовать без присмотра человека и его корректировок.

Галлюцинирование нейронных сетей случается из-за сложности системы, больших объёмов данных, которые надо обработать (и также из-за их недостаточности). Непонятны причины принятия решений, не всегда даётся однозначный ответ, а вероятностный. Кроме того, нейронные сети подвержены взлому, а иногда они начинают сходить с ума из-за частого повторного обучения.

Старайтесь задавать чёткий запрос нейронке, добавлять контекст и обязательно проверять результаты на достоверность.

*Продукт компании Meta, запрещённой в РФ