Удаление сайта из поиска Google и «Яндекс»

Содержание

Зачем может потребоваться удалить сайт из поиска

Вебмастеры удаляют сайты и их отдельные страницы из индекса по разным причинам:

-

переезд web-ресурса на другой домен, когда прежний сайт нужно закрыть, чтобы пользователи находили в интернете только актуальный;

-

наличие в поиске дублей всего сайта или его страниц, чтобы домен не попал под фильтры за нарушение правил поисковиков;

-

наличие на сайте неактуальной информации. Например, при покупке готового ресурса с контактными данными, описаниями и товарами прежнего владельца необходимо время, чтобы заменить их. В этом случае web-проект лучше скрыть от индексации, чтобы не вводить пользователей в заблуждение.

Удаление страницы из «Яндекса»

Существуют 3 рабочих способа, как удалить страницу из поиска Яндекса. Подробнее разберем каждый из них.

Через «Яндекс.Вебмастер»

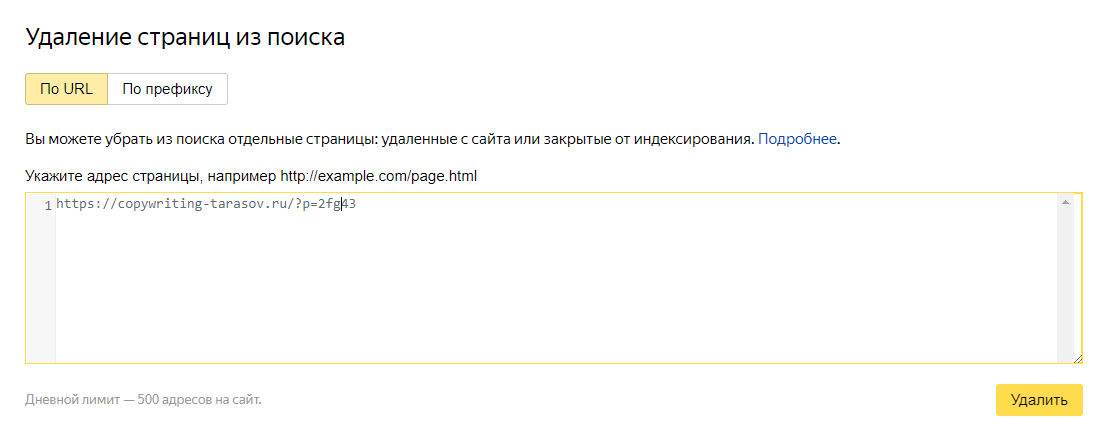

Для начала расскажем, как удалить сайт через Яндекс Вебмастер.

-

откройте в браузере сервис Вебмастер;

-

найдите вкладку «Инструменты»;

-

кликните по кнопке «Удаление страниц из поиска».

После этого откроется окно, в котором необходимо указать ссылки на удаление.

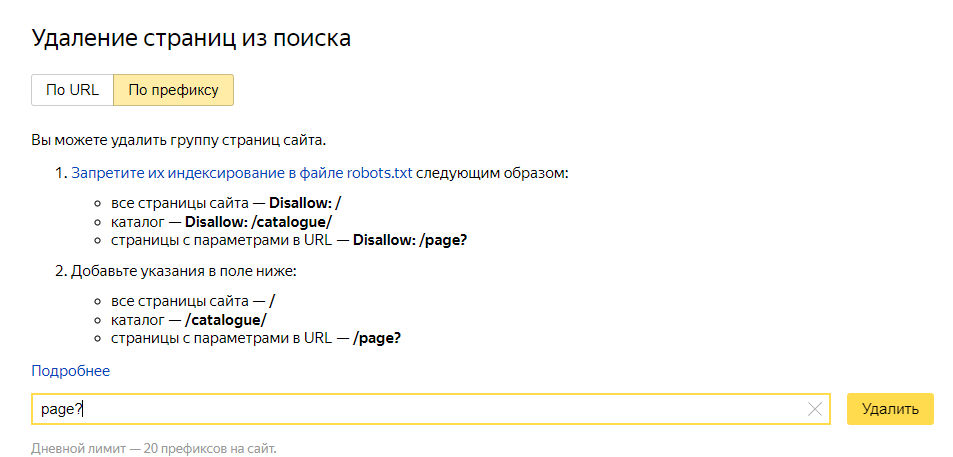

За сутки можно закрыть не более 500 адресов на сайт. Если же нужно через вебмастер удалить 500+ страниц из поиска, то стоит использовать вариант закрытия «По префиксу».

Такой метод позволяет закрывать целые разделы сайта за раз. Нужно указать только префикс, который стоит перед телом ссылки. Укажите его, а затем нажмите на «Удалить».

Яндекс Вебмастер — это самый надежный способ удалять сайты и их отдельные страницы из поиска. Все добавленные вышеперечисленными способами URL гарантированно не будут проверяться краулерами и не появятся в выдаче по запросам.

Удаление страницы (404)

Ошибка 404 Not Found означает, что страницу не удалось найти. Сервер отвечает на пользовательский запрос, но соответствующего контента просто нет. Обычно 404-страница появляется, когда вебмастер ранее удалил ее.

Вручную убирать такую ссылку из поиска не нужно. Краулер, сканирующий сайты, автоматически удаляет нерелевантные URL после переобхода в течение недели.

Чтобы ускорить процедуру и быстрее удалить страницы, рекомендуется отправить сайт на принудительную переиндексацию. Как это сделать:

-

откройте «Яндекс.Вебмастер»;

-

перейдите в раздел «Переобход страниц» и укажите адрес устаревшей страницы;

-

нажмите на «Отправить».

Краулеры Яндекса при следующем обходе приоритетно проверяют ссылки из этого списка. Если они обнаружат ошибку 404, то, как и всегда, просто решат удалить эту страницу.

Через robots.txt

Robots.txt — это специальный документ, который используется краулерами как инструкция. В файле они понимают, что можно и нельзя сканировать и, соответственно, добавлять в индекс.

Чтобы установить запрет на сохранение определенных страниц, используйте стандартную директиву Disallow. Ее указывают в начале строки, а через двоеточие вводят ссылку на конкретную страницу или префикс.

Если вам нужно удалить страницы из поиска только в Яндекс, то в самом начале фрагмента с запрещенными к индексации ссылками укажите User-agent: Yandex. Эта помета указывает, что дальнейшие инструкции предназначены только для Яндекса. Краулеры Google не будут их выполнять.

Работая с robots.txt, нужно помнить, что данный файл — набор рекомендаций, а не жестких правил. Иногда поисковики нарушают их, из-за чего страницы сканируются и даже попадают в SERP.

Через метатеги

Если у вас простой одностраничник, или сайт сделан на чистом HTML, то можно закрыть индексацию через мета-теги. Для этого следует прописать тег robots с параметром noindex.

Чтобы данный способ заработал, впишите между тегами head стандартную конструкцию: . Отметим, что таким же образом работают с другими поисковиками. Просто замените Yandex на Google или другую систему.

Крайне важно оставить этот тег в самом начале документа. Если краулер заметит ее сразу при входе, то 100% не продолжит дальнейшую работу с ресурсом.

Удаление сайта из Google

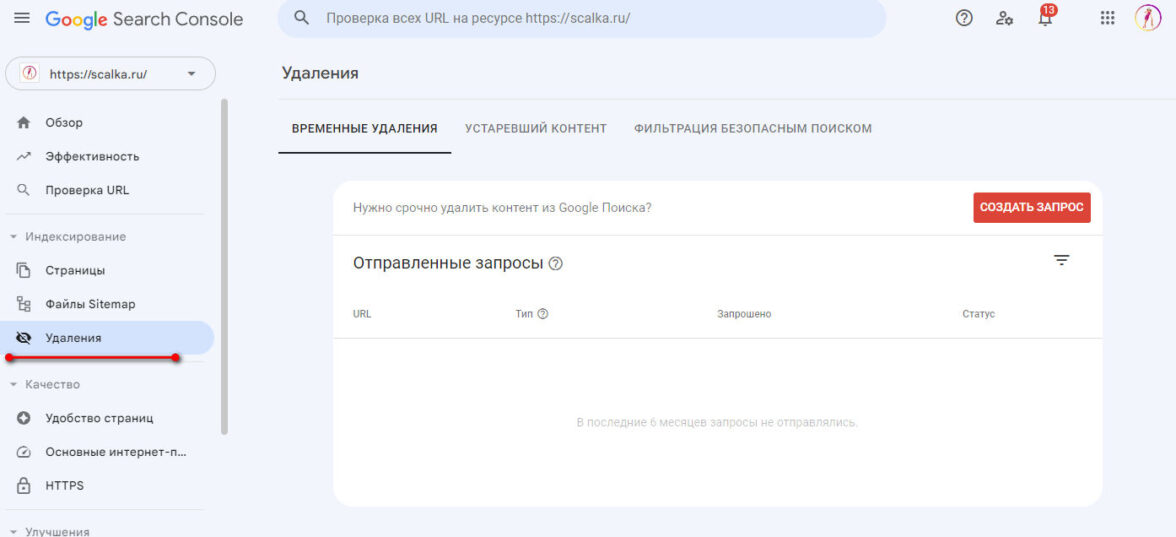

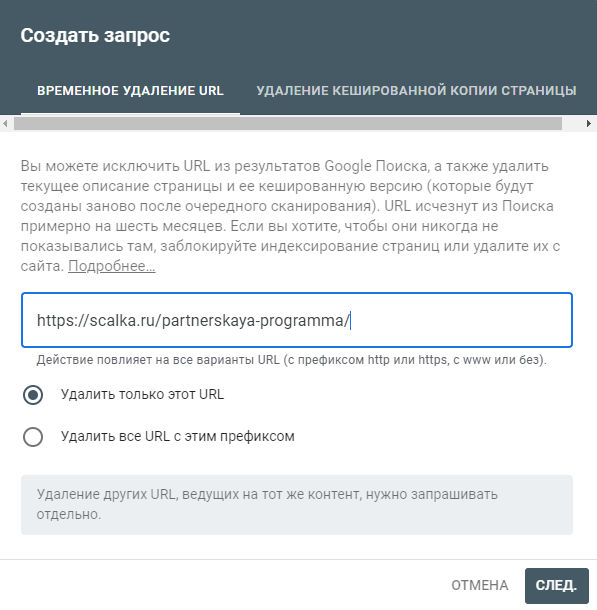

Теперь подробно расскажем, как удалить сайт из поисковика Google. У Google Search Console, как и у Яндекс.Вебмастера, есть специальный инструментарий для удаления лишних страниц. В меню слева нажмите на «Удаление», а затем — на «Создать запрос».

На экране откроется окно с 2 вариантами:

-

Временное удаление — пользователь указывает ссылку, после чего в Google больше не будет отображаться определенная страница. Однако через некоторое время она снова появится. Чтобы навсегда избавиться от страницы, следует удалить документы или настроить метатеги;

-

Удаление кэшированной копии — в таком случае Google сотрет сохраненные в кэше копии страниц. Этот вариант подойдет, если информация на них потеряла актуальность.

Подробнее рассмотрим первый вариант, как убрать ненужный сайт из поиска Google:

-

вставьте URL в поле окна «Создать запрос»;

-

активируйте опцию «Удалить только этот URL». Если вам нужно удалить еще с этого сайта аналогичные страницы, то стоит использовать вместо ссылки префиксы и функцию «Удалить все URL с этим префиксом».

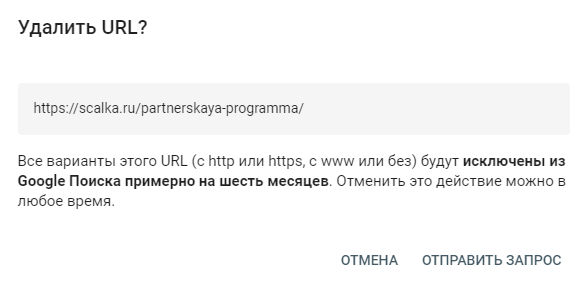

Затем на экране появится предупреждение, в котором пользователя предупреждают, что все вариации URL перестанут отображаться в поиске по ключевым запросам. Нажмите на «Отправить запрос».

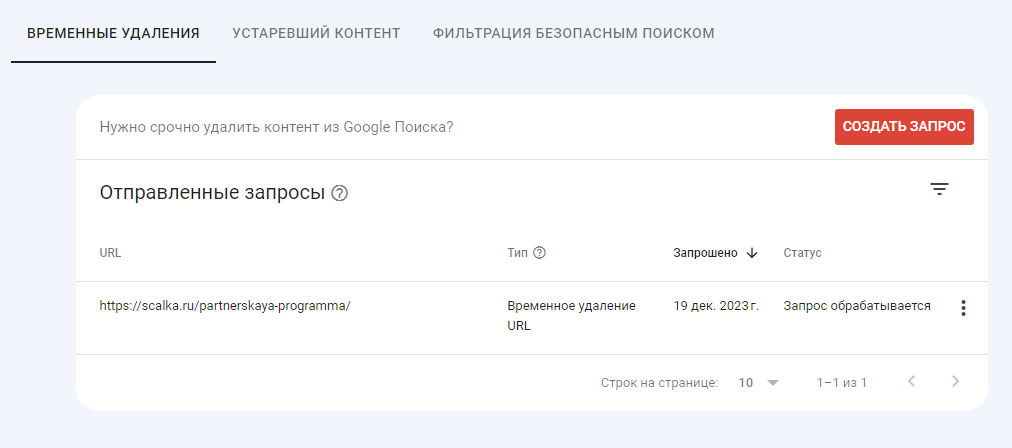

На странице «Удаление» отображаются все пользовательские запросы на закрытие от индексации. Они выполняются не сразу, а в течение нескольких дней. В Google Search Console можно отслеживать актуальный статус заявки.

Отметим, что в 2024 году Google перестает учитывать директивы robots.txt. Краулеры уже не воспринимают инструкцию nofollow. Возможно, в будущем данный файл вообще не будет использоваться для удаления сайта и страниц из поиска.

Коротко о главном

Чтобы гарантированно удалить страницу или сайт из поиска, рекомендуется использовать несколько способ сразу. Краулеры могут пропустить инструкцию в одном источнике, поэтому дублирование запретов — нормальная практика.

При этом приоритетным способом удаления становится «Вебмастер» и Search Console. Google постепенно снижает вес robots.txt, из-за чего краулеры не учитывают запрещающие директивы. Поэтому в первую очередь нужно поставить запрет на индексацию в специализированных инструментах.